摘 要:对于晶圆表面缺陷检测来说,缺陷样本存在着样本数量不足,缺陷表现形式多样的问题。为解决此类问题,提出了一种基于改进生成对抗网络的晶圆表面缺陷检测模型。该模型首先在GANomaly模型的基础上引入了跳层连接,并引入CBAM注意力机制,用以更好地关注图像重要区域,其次引入记忆模块以约束潜在空间的表示,最后在原模型架构上新增一个自编码器架构判别器,以确保训练更稳定,更容易收敛到最佳平衡点。实验结果表明,该模型能够准确分辨具有缺陷的晶圆样本,检测精度达到了0.985,相较于GANomaly算法提升了6.7%。对于Mvtec AD数据集,检测精度达到了0.79,相较于GANomaly算法提升了3%。

关键词:晶圆表面缺陷;生成对抗网络;CBAM;记忆模块

中图分类号:T391.4 文献标识码:A 文章编号:2096-4706(2024)20-0037-07

Wafer Surface Defect Detection Based on Improved Generative Adversarial Network

LING Hongwei, ZHANG Jianmin

(School of Artificial Intelligence, Jianghan University, Wuhan 430056, China)

Abstract: For wafer surface defect detection, there are problems that the number of defect samples is insufficient and the defects are in various forms. In order to solve such problems, a wafer surface defect detection model based on improved Generative Adversarial Network is proposed. Firstly, the model introduces layer hopping connection on the basis of the GANomaly model, and introduces CBAM Attention Mechanism to better focus on the important regions of the image. Secondly, it introduces a memory module to constrain the representation of the potential space. Finally, it adds a new autoencoder architecture discriminator on the original model architecture to ensure that the training is more stable and it is easier to converge to the optimal equilibrium point. The experimental results show that the model is able to accurately distinguish wafer samples with defects, and the detection accuracy reaches 0.985, which is improved by 6.7% compared to the GANomaly algorithm. For the Mvtec AD dataset, the detection accuracy reaches 0.79, which is improved by 3% compared to the GANomaly algorithm.

Keywords: wafer surface defect; Generative Adversarial Network; CBAM; memory module

0 引 言

现代半导体芯片[1]采用高级硅材料和精细制造工艺,具有高集成度、高性能、低能耗和快速处理速度等特点,使其在高科技领域中扮演着核心角色。晶圆作为重要组成材料,伴随着芯片的高密度集成也为其带来了艰巨挑战,由于晶体管数量的急剧增加,晶圆[2]在设计和制造过程中的复杂性也随之增加,这就要求使用先进的光刻技术和精确的制造流程来确保每个晶圆的性能。

早期,在计算机视觉和机器学习领域,表面缺陷检测的经典方法包括边缘检测[3]、纹理分析[4]、颜色分析[5]等。然而,这些方法大多需要大量的人工参与,不仅需要人工设定和调整特征提取的参数,还需要人工标注大量的训练样本。此外,这些方法的抗噪声能力和泛化能力往往较弱,对于复杂的、不规则的、多样的表面缺陷[6],识别效果不尽如人意。因此,无监督的缺陷检测显得尤为重要。

无监督学习[7]因为其无须依赖标签数据的优势,已在图像异常检测领域得到广泛应用。隶属于无监督学习的生成对抗网络(GAN)通过探究数据本身的内在特性,能有效识别并挖掘出数据的共通性,测量异常得分以实现图像异常的检测。这使其在各类工业环境下的图像异常检测中发挥了重要作用。

2017年,Lee[8]提出的AnoGAN是第一个将GAN运用到缺陷检测领域的模型,其引入双向GAN来利用潜在空间编码进行异常评分,但其因为多次迭代,存在着计算复杂性大的问题。2018年,Akcay等人[9]提出GANomaly解决了AnoGAN计算复杂性的问题,其引入了自编码器结构作为生成器以提高计算效率,并开发了一个可解释局部异常的标准化分数。2019年,Youkachen等人[10]通过使用卷积自动编码器(CAE)和锐化过程来提取输入图像的缺陷特征,然后应用后处理进行可视化,对热轧钢带表面进行缺陷分割。2019年,Yang等人[11]提出了一种基于无监督多尺度特征聚类的全卷积自动编码器(MS-FCAE)方法,该方法利用不同尺度级别的多个特征AE子网络来重建多个纹理背景图像。该方法在多个纹理数据集上实现了92.0%的精度。

为此,本文为实现更好的缺陷检测能力,针对晶圆表面缺陷数据集提出了一种基于改进生成对抗网络的晶圆表面缺陷检测模型,在GANomaly模型的基础上引入了跳层连接,在反向传播时,有效减少梯度消失、梯度爆炸现象,并在跳层连接处引入CBAM注意力机制[12]帮助模型更好地关注图像的重要区域和重要特征;为约束潜在空间的表示从而引入记忆模块MemAE[13],使得重构后的图像样本分布接近正常样本。最后,在原模型架构上新增一个自编码器架构判别器,以确保训练更稳定,更容易收敛到最佳平衡点。

1 相关工作

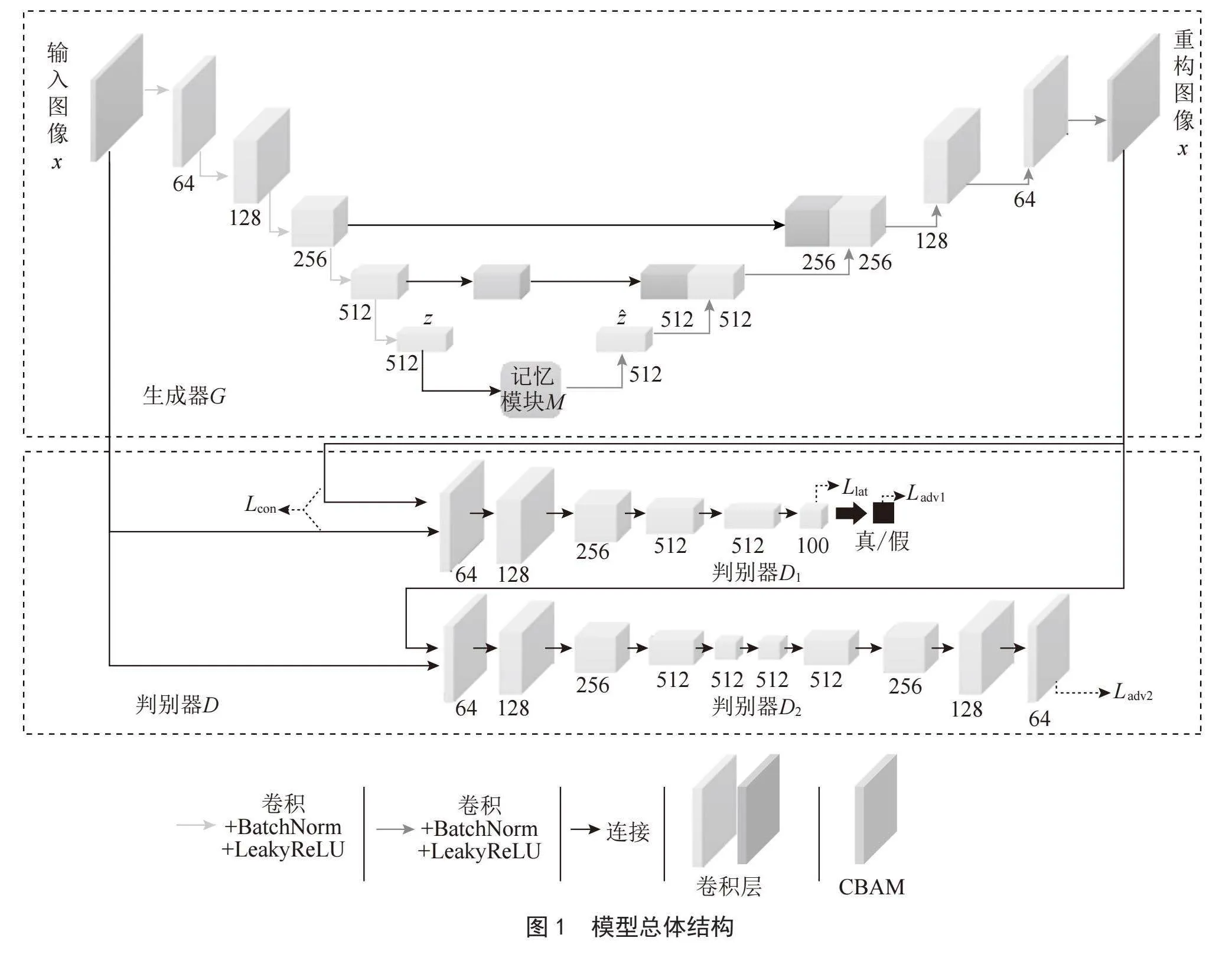

1.1 模型总体结构

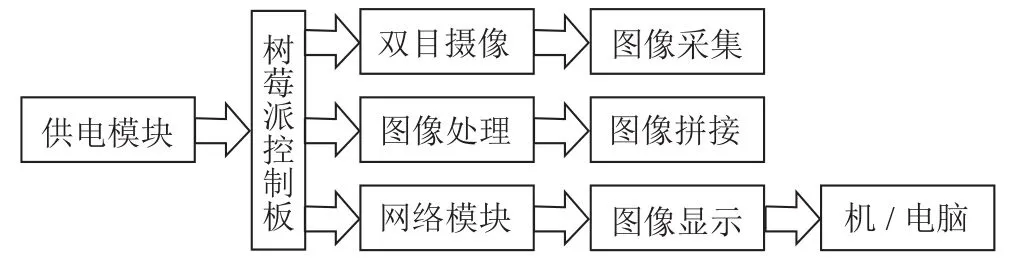

本文所提出的基于改进生成对抗网络的晶圆表面缺陷检测模型架构如图1所示,该模型由5部分构成:编码器GE、解码器GD、记忆模块M和判别器D1以及判别器D2。

生成器模块由编码器GE、记忆模块M、解码器GD组成:输入图像x,编码器GE对其进行编码,获取潜在特征z,记忆模块检索与其最为相似的特征,得到新的潜在特征,最后将输入解码器GD进行上采样,得到重构图像。

判别器模块由判别器D1,D2组成:判别器D1获取输入图像x和重建图像 从而得到潜在表示,并预测其类标签。判别器D2根据BEGAN[14]模型思想,为自编码器结构,以最小化生成器G和最大化判别器D2来达到,以确保训练更稳定,更容易收敛到最佳平衡点。

1.2 编码器和解码器

编码器GE用于将高维图像x映射到低维潜在特征z来捕获输入图像的数据分布,输入图像x在编码器网络中通过5个模块,每个模块包含卷积层、BatchNorm层和LeakyReLU激活函数并输出潜在特征z,也称为带有独特表示的瓶颈特征。

解码器GD用于将潜在特征映射为重构图像,有着与编码器GE对称的网络结构,潜在特征在解码器网络中经历5个块,每个模块包含反卷积层、BatchNorm层和ReLU激活函数。另外该模型也同时引入了跳层连接,通过层与层之间的直接信息传输,保留了更多的图像特征,从而帮助产生更好的重建。

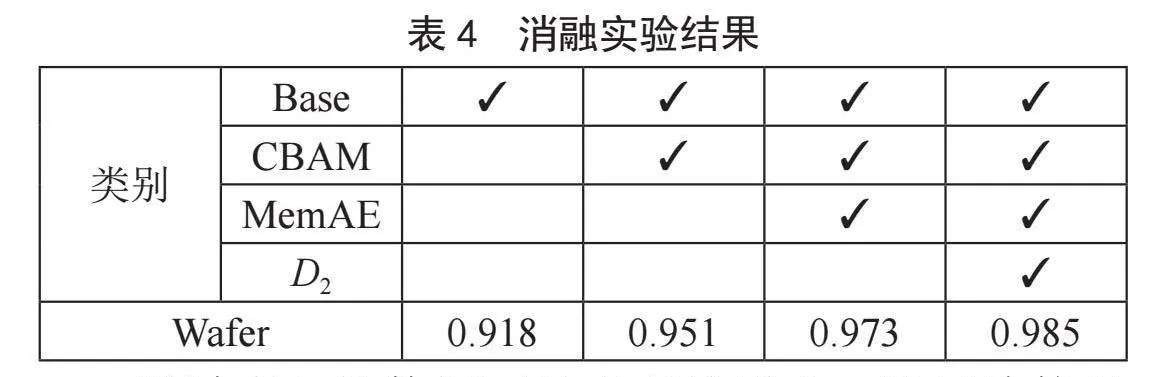

1.3 MemAE记忆模块

在生成器重构图像的过程中,往往会因为自编码器的泛化能力过强,部分异常也能被很好地重构,导致重构误差较小,降低了异常检测的准确率。为有效解决该问题,本文引入了记忆模块MemAE用以强化正样本特征,扩大正常样本与缺陷样本之间的重构误差,其工作原理是通过获取编码器GE输出的潜在特征z,将其用作查询条件来检索最相关的记忆项进行重建得到以输入到解码器GD。在训练阶段,记忆内容被更新为更能代表正常样本的记忆元素。在测试阶段,通过记忆模块的寻址操作得到的潜在特征仅包含与正样本相关的图像信息,针对缺陷样本会产生更大的重构误差,以提高模型的检测效果,记忆模块结构如图2所示。

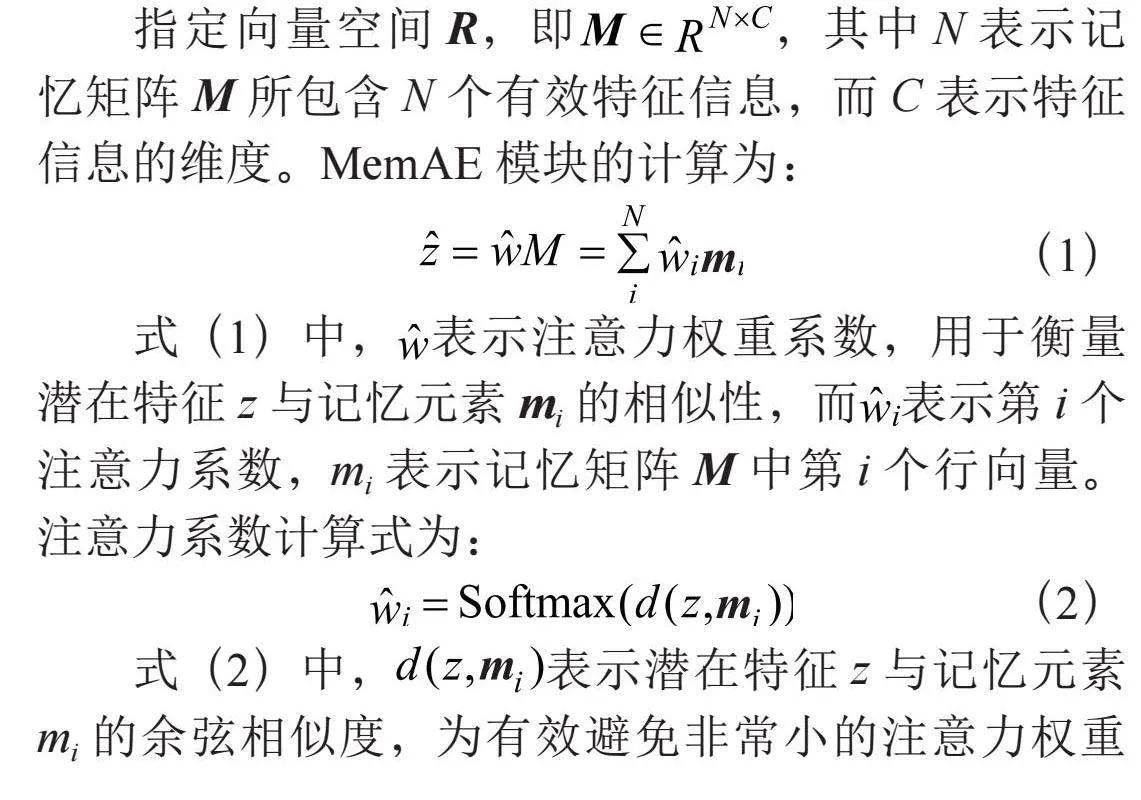

指定向量空间R,即,其中N表示记忆矩阵M所包含N个有效特征信息,而C表示特征信息的维度。MemAE模块的计算为:

(1)

式(1)中,表示注意力权重系数,用于衡量潜在特征z与记忆元素mi的相似性,而表示第i个注意力系数,mi表示记忆矩阵M中第i个行向量。注意力系数计算式为:

(2)

式(2)中,表示潜在特征z与记忆元素mi的余弦相似度,为有效避免非常小的注意力权重使缺陷样本仍旧具有较好的重构效果,MemAE引入了稀疏处理的操作,如式(3)所示:

(3)

式(3)中,λ表示稀疏阈值,将小于λ的注意力权重系数wi设置为0,并进行归一化,其中ε>0且数值非常小,避免分母为0。

1.4 CBAM注意力机制

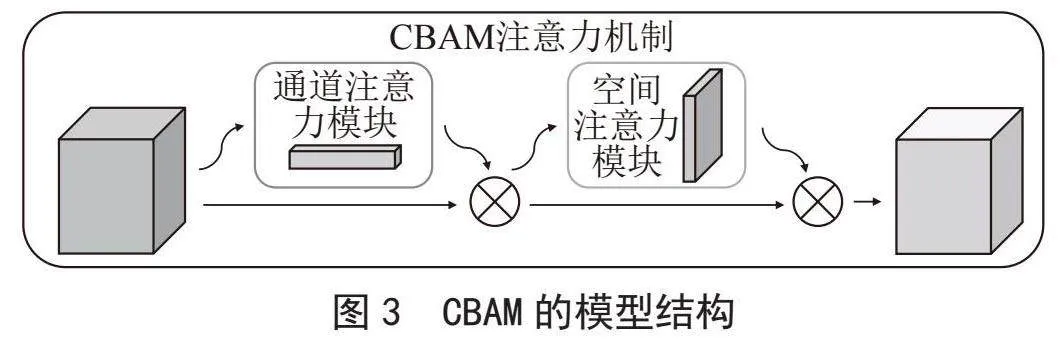

CBAM是一种混合注意力机制,旨在帮助模型更好地捕捉图像中的重要信息,从而提高其性能和泛化能力。主要由通道注意力模块和空间注意力模块两大部分组成。通道注意力模块通过计算每个通道的重要性权重来告诉模型更应该强调哪些通道的信息,以便更好地捕捉特征。空间注意力模块通过计算每个空间位置的重要性权重来告诉网络应该更关注哪些位置的信息,具体结构如图3所示。

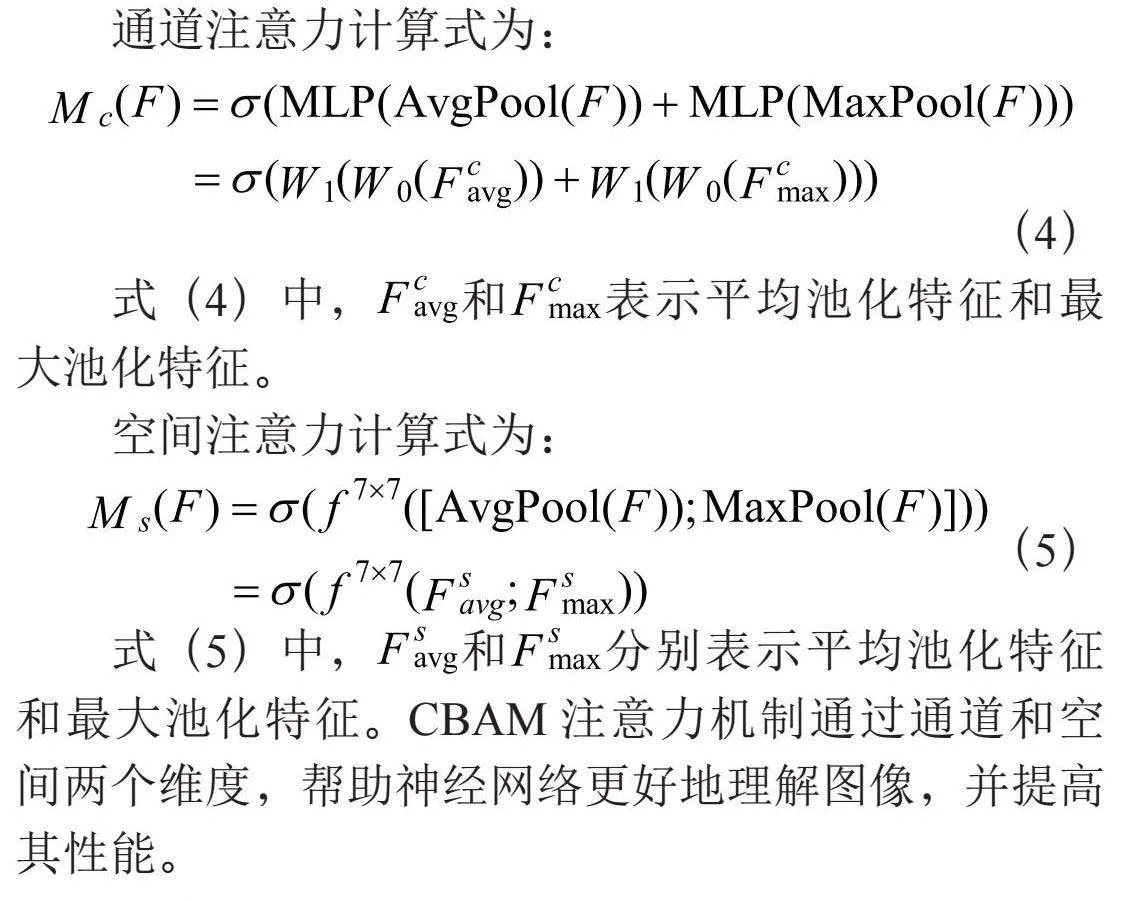

通道注意力计算式为:

(4)

式(4)中,和表示平均池化特征和最大池化特征。

空间注意力计算式为:

(5)

式(5)中,和分别表示平均池化特征和最大池化特征。CBAM注意力机制通过通道和空间两个维度,帮助神经网络更好地理解图像,并提高其性能。

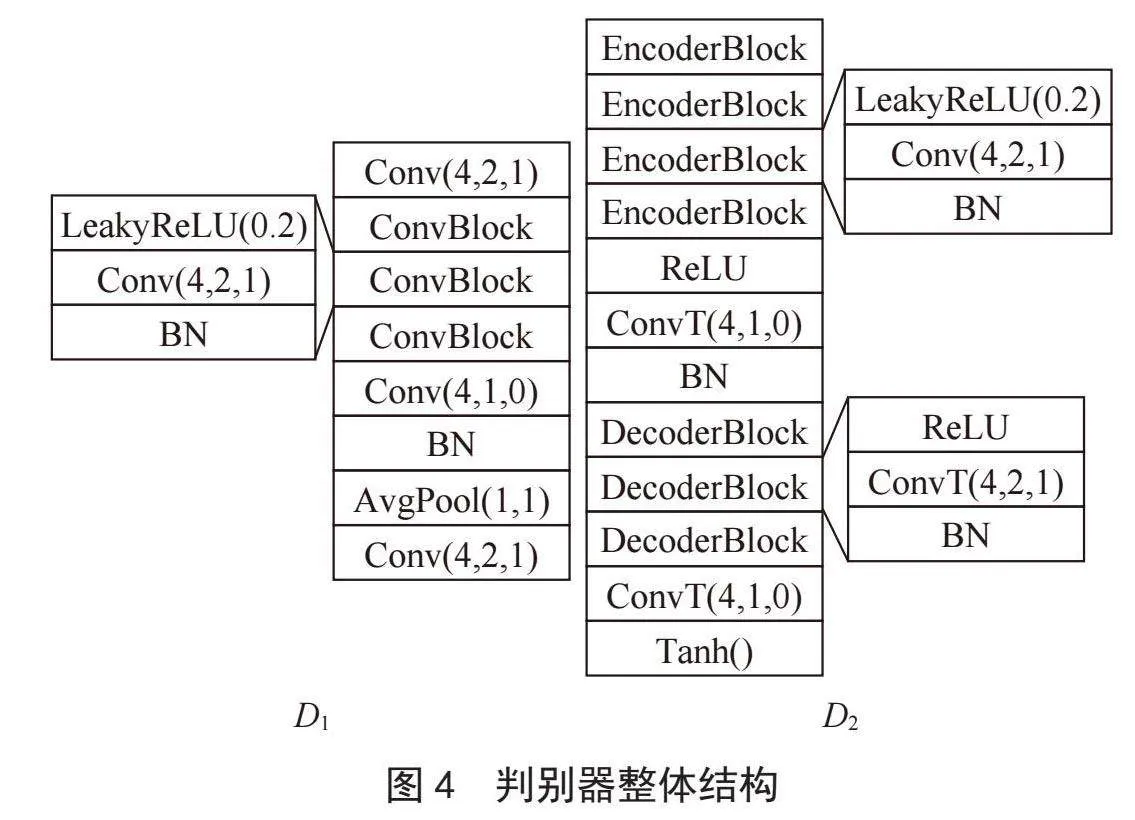

1.5 判别器

本模型分别包含判别器D1和判别器D2,判别器D1的主要任务是区分真实图像或生成图像,判别器D2的主要任务是用以约束生成器以强化生成器的重构能力。两者的目的均是最小化其输入图像x与重构图像之间的差异,让生成器和判别器学习正常数据的底层分布。

其中判别器D1通过转置卷积,BatchNorm2d,LeakyReLU激活函数不断地改变特征维度,最后通过Sigmoid激活函数判断图像的真假。判别器D2采用自编码器结构,用以强化生成器的重构能力,以确保模型训练更稳定,判别器整体卷积架构如图4所示。

1.6 损失函数

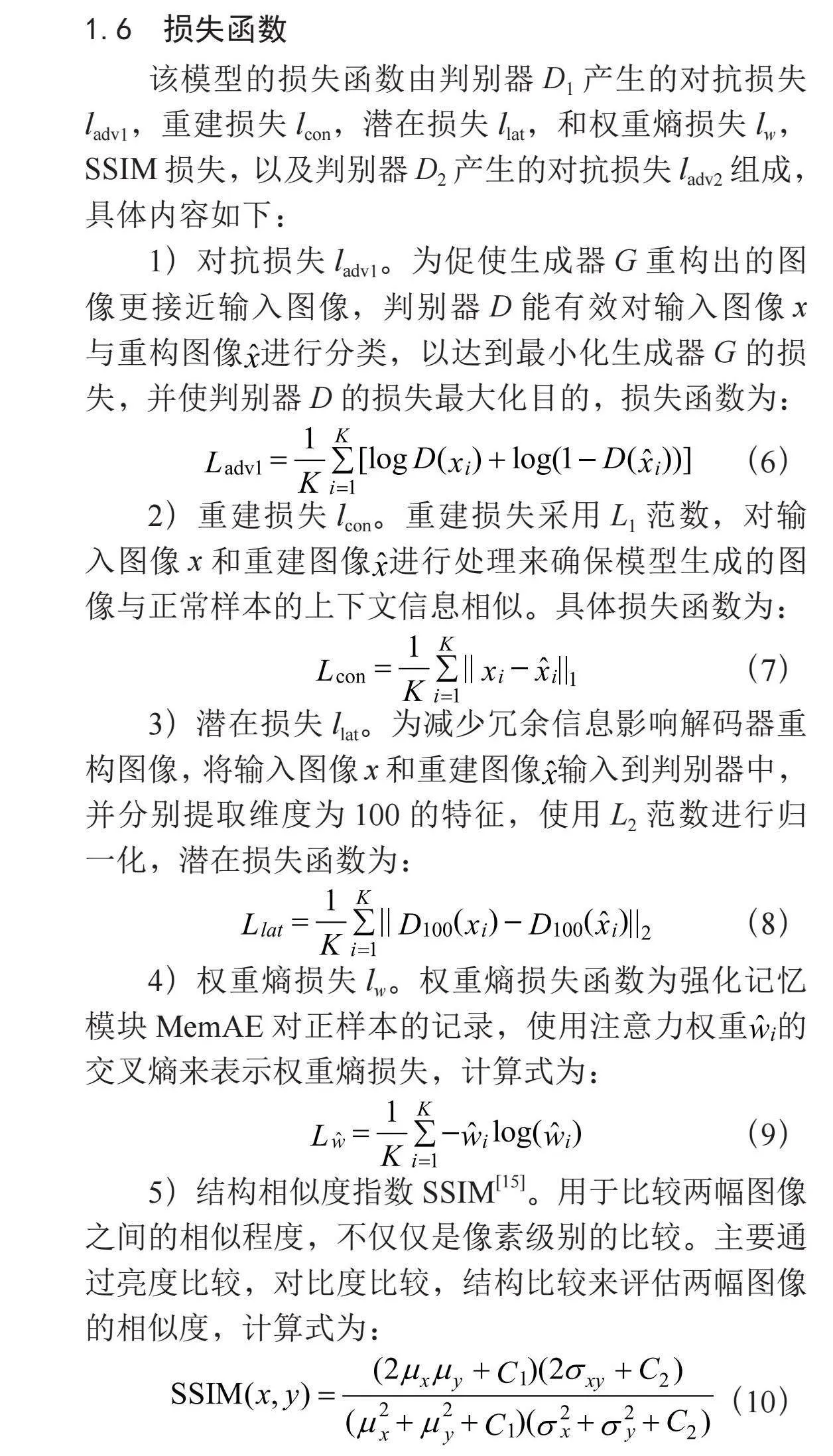

该模型的损失函数由判别器D1产生的对抗损失ladv1,重建损失lcon,潜在损失llat,和权重熵损失lw,SSIM损失,以及判别器D2产生的对抗损失ladv2组成,具体内容如下:

1)对抗损失ladv1。为促使生成器G重构出的图像更接近输入图像,判别器D能有效对输入图像x与重构图像进行分类,以达到最小化生成器G的损失,并使判别器D的损失最大化目的,损失函数为:

(6)

2)重建损失lcon。重建损失采用L1范数,对输入图像x和重建图像进行处理来确保模型生成的图像与正常样本的上下文信息相似。具体损失函数为:

(7)

3)潜在损失llat。为减少冗余信息影响解码器重构图像,将输入图像x和重建图像输入到判别器中,并分别提取维度为100的特征,使用L2范数进行归一化,潜在损失函数为:

(8)

4)权重熵损失lw。权重熵损失函数为强化记忆模块MemAE对正样本的记录,使用注意力权重的交叉熵来表示权重熵损失,计算式为:

(9)

5)结构相似度指数SSIM[15]。用于比较两幅图像之间的相似程度,不仅仅是像素级别的比较。主要通过亮度比较,对比度比较,结构比较来评估两幅图像的相似度,计算式为:

(10)

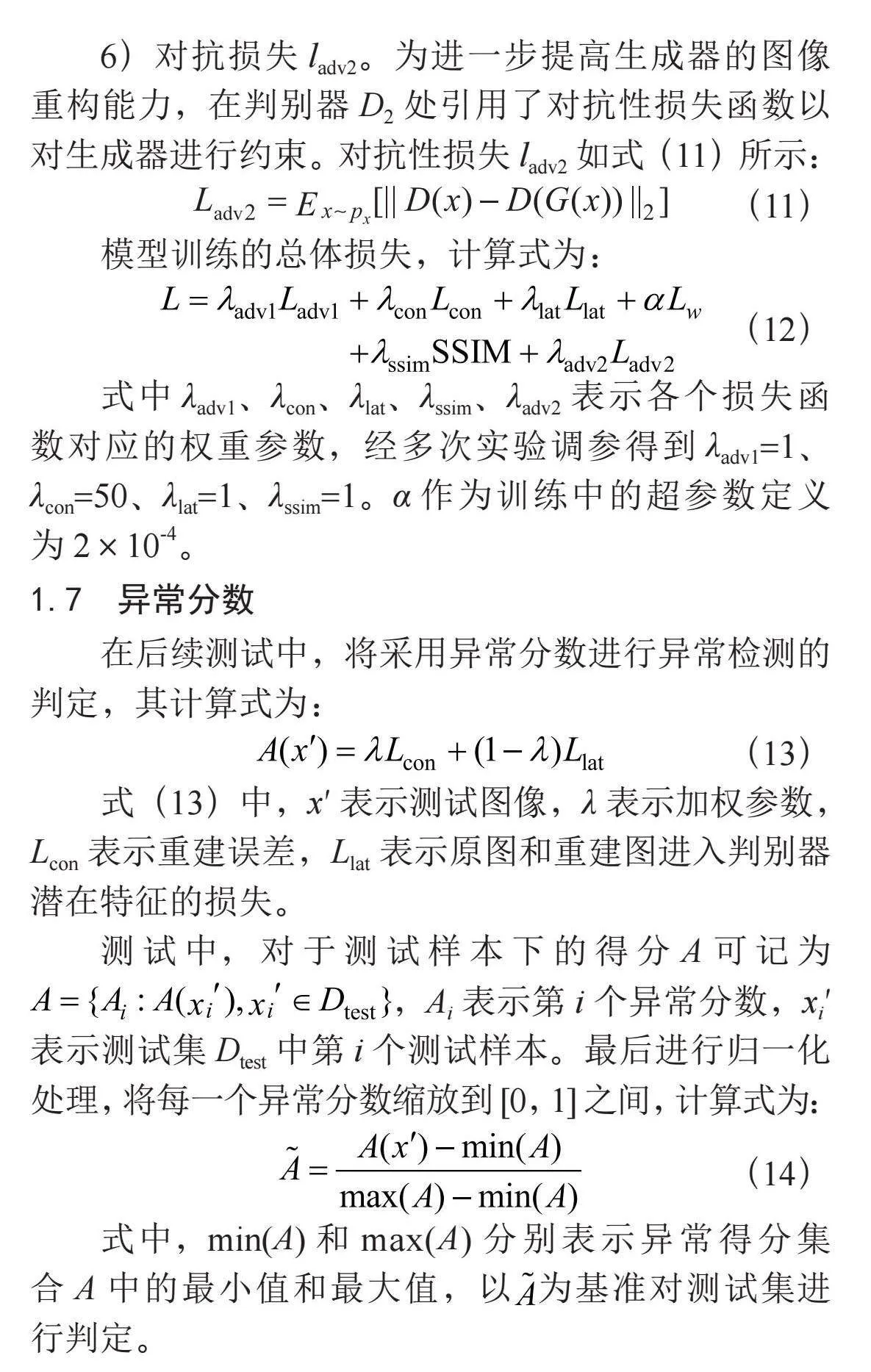

6)对抗损失ladv2。为进一步提高生成器的图像重构能力,在判别器D2处引用了对抗性损失函数以对生成器进行约束。对抗性损失ladv2如式(11)所示:

(11)

模型训练的总体损失,计算式为:

(12)

式中λadv1、λcon、λlat、λssim、λadv2表示各个损失函数对应的权重参数,经多次实验调参得到λadv1=1、λcon=50、λlat=1、λssim=1。α作为训练中的超参数定义为2×10-4。

1.7 异常分数

在后续测试中,将采用异常分数进行异常检测的判定,其计算式为:

(13)

式(13)中,x′表示测试图像,λ表示加权参数,Lcon表示重建误差,Llat表示原图和重建图进入判别器潜在特征的损失。

测试中,对于测试样本下的得分A可记为,Ai表示第i个异常分数,xi′表示测试集Dtest中第i个测试样本。最后进行归一化处理,将每一个异常分数缩放到[0,1]之间,计算式为:

(14)

式中,min(A)和max(A)分别表示异常得分集合A中的最小值和最大值,以为基准对测试集进行判定。

2 实验结果及分析

2.1 数据集

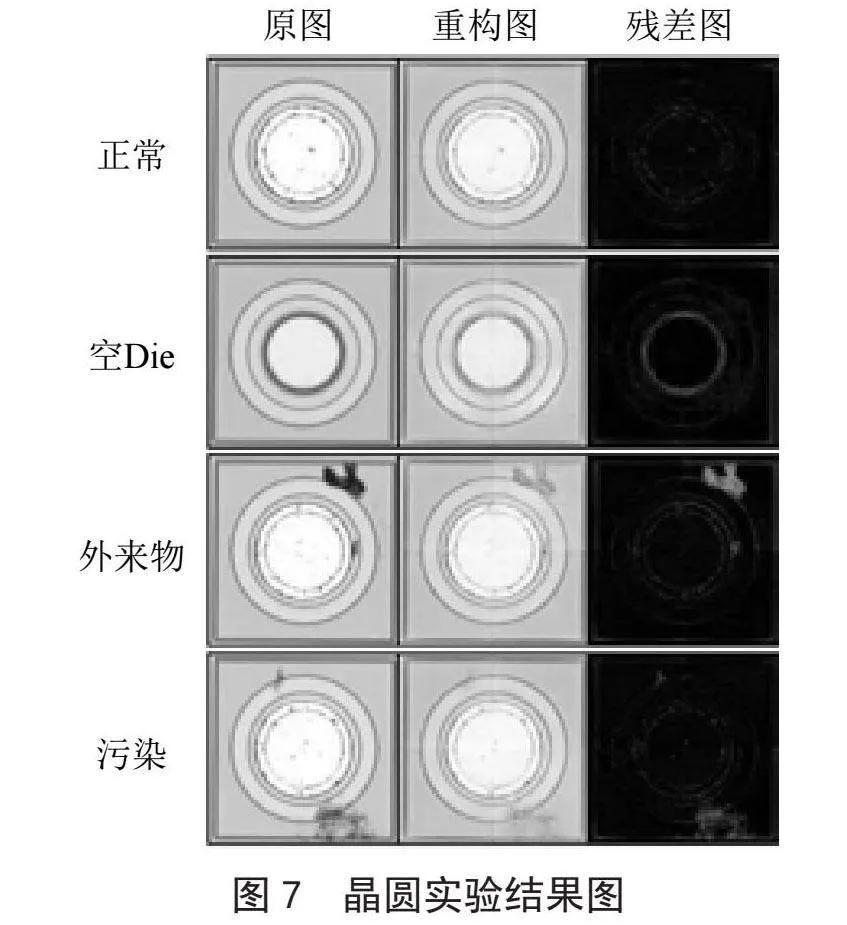

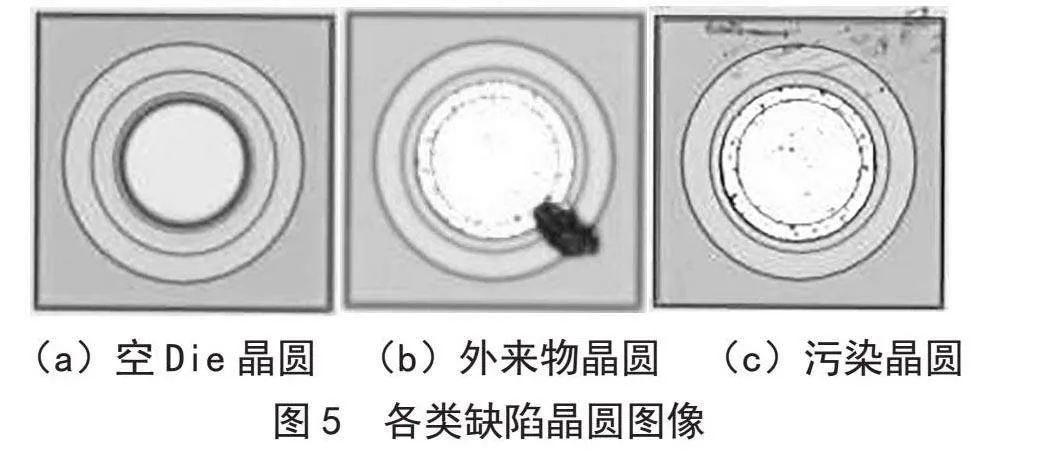

本次实验的晶圆数据集是由某半导体公司在实际生产环境中提供的,每张图像大小均在130×130。总共477张图像数据集,其中训练集277张均为正样本、测试集200张,由100个正样本,100个负样本组成,以达到数据平衡性,按照缺陷晶圆的图像特征和命名规范,把采集的晶圆图像缺陷类型分为以下三类:空Die缺陷(KD)、外来物缺陷(WLW)、污染缺陷(ZW),图5展示了缺陷数据集中各类缺陷的晶圆图像。

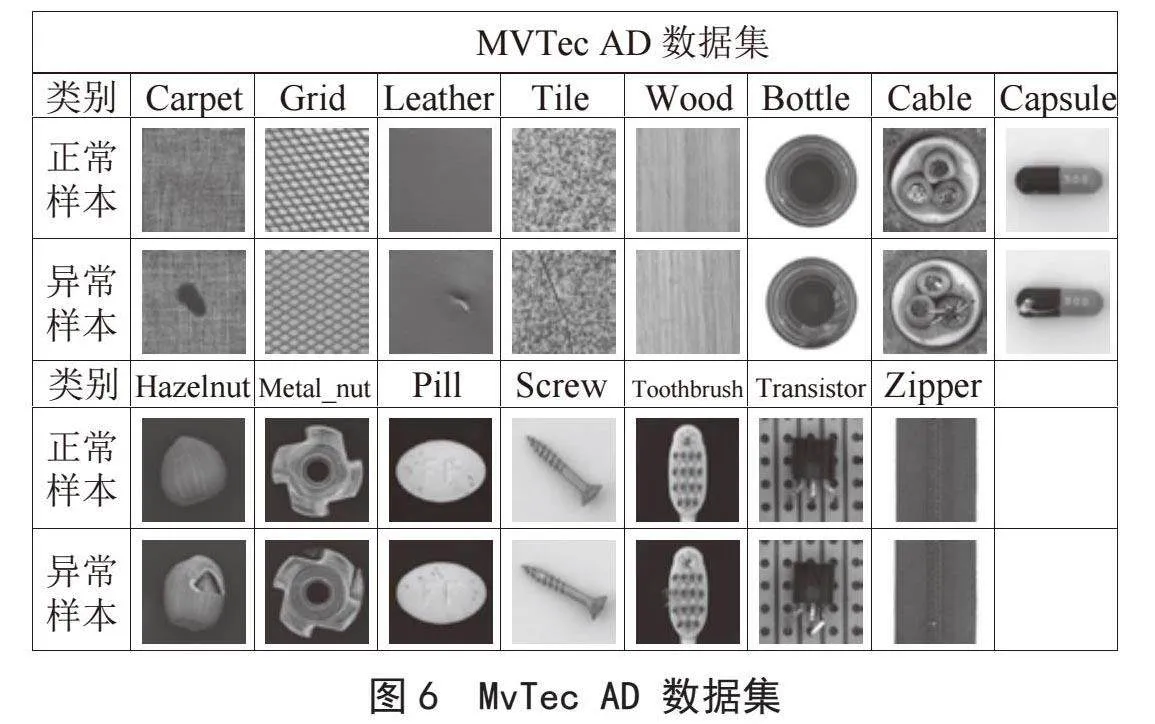

为进一步验证模型的性能,同时对公共数据集Mvtec AD数据集[16]进行实验。Mvtec AD数据集总共分为两大类:纹理类与物体类,其中纹理类涵盖了地毯、网格和皮革等5类数据集,物体类由瓶子、金属螺母和电缆等10类数据集组成,其缺陷多样,具有一定的说服力,样本数据如图6所示。

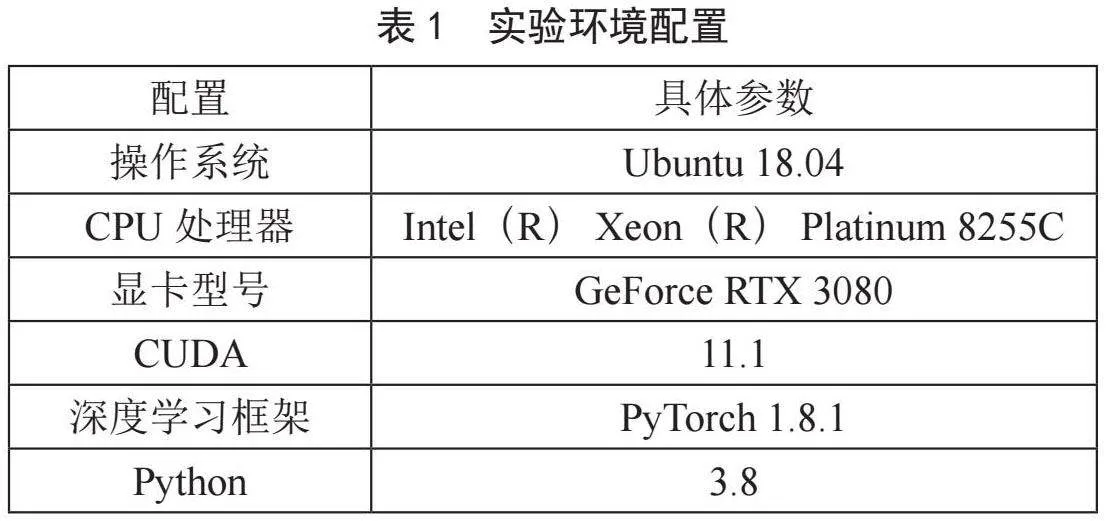

2.2 实验环境

实验所使用的平台及运行环境配置如表1所示。

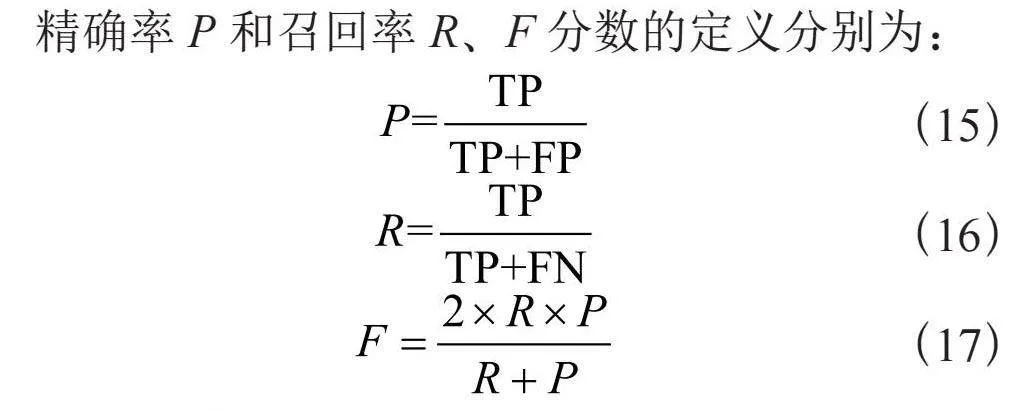

2.3 性能评估指标

本文采取通过精确率(P)和召回率(R)、F1分数(F)以及ROC的曲下面积AUC来对模型性能进行度量。在缺陷实验中,常用混淆矩阵(Confusion Matrix)来表示样本预测值的正负和样本真实值的正负之间的关系,混淆矩阵如表2所示。

2.4 训练细节及参数设置

输入模型图像大小均为64×64像素,Epoch为50,每批次输入64张图像,初始学习率为0.000 2,衰减动量b1 = 0.5,b2 = 0.999,异常分数中加权参数λ = 0.9。

2.5 实验结果

为了验证模型的有效性,利用晶圆数据集与无监督模型AnoGAN、EGBAD、GANomaly进行对比实验,对比结果如表3所示。

表3从精确率和召回率、F1分数及AUC进行全面评估模型晶圆表面缺陷检测的能力。AnoGAN和EGBAD的AUC值分别为0.592、0.594,这意味着两者无法有效的区分正常和异常样本,不具备对异常图像的缺陷检测能力。相比之下GANomaly的整体效果得到了极大的提升,AUC值达到了0.918,具有较高的正样本识别能力,同时也保持了相对较高的召回率。本文所提出的模型在所有评估指标上均表现卓越,精确率达到完美的1.0意味着在识别异常时没有产生任何误报,而高召回率也确保了大多数异常能被识别,本模型的AUC值相较于GANomaly提升了6.7%,实验中晶圆数据集缺陷检测可视化数据图如图7所示。

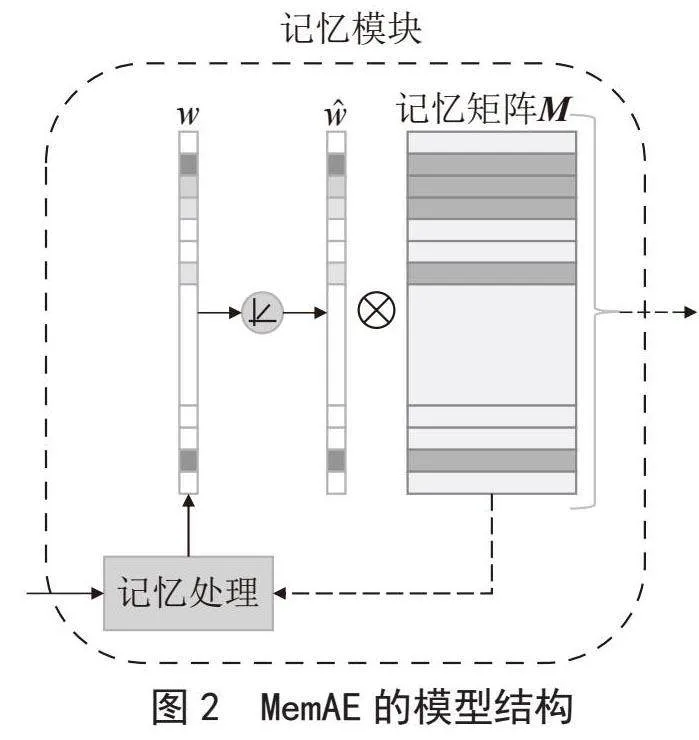

为进一步验证本章对模型所做改进对晶圆表面缺陷检测的有效性,对模型增加的CBAM注意力机制,MemAE记忆模块以及新增自编码式判别器进行消融实验,实验结果如表4所示。在表4中,Base表示基准模型GANomaly;CBAM表示在生成器第3、4层引入跳层连接,并于第四层连接处添加CBAM注意力机制;MemAE表示在生成器模块处引入记忆模块;D2表示在判别器模块中增添一个自编码式判别器,表格中空白项表示无此项。

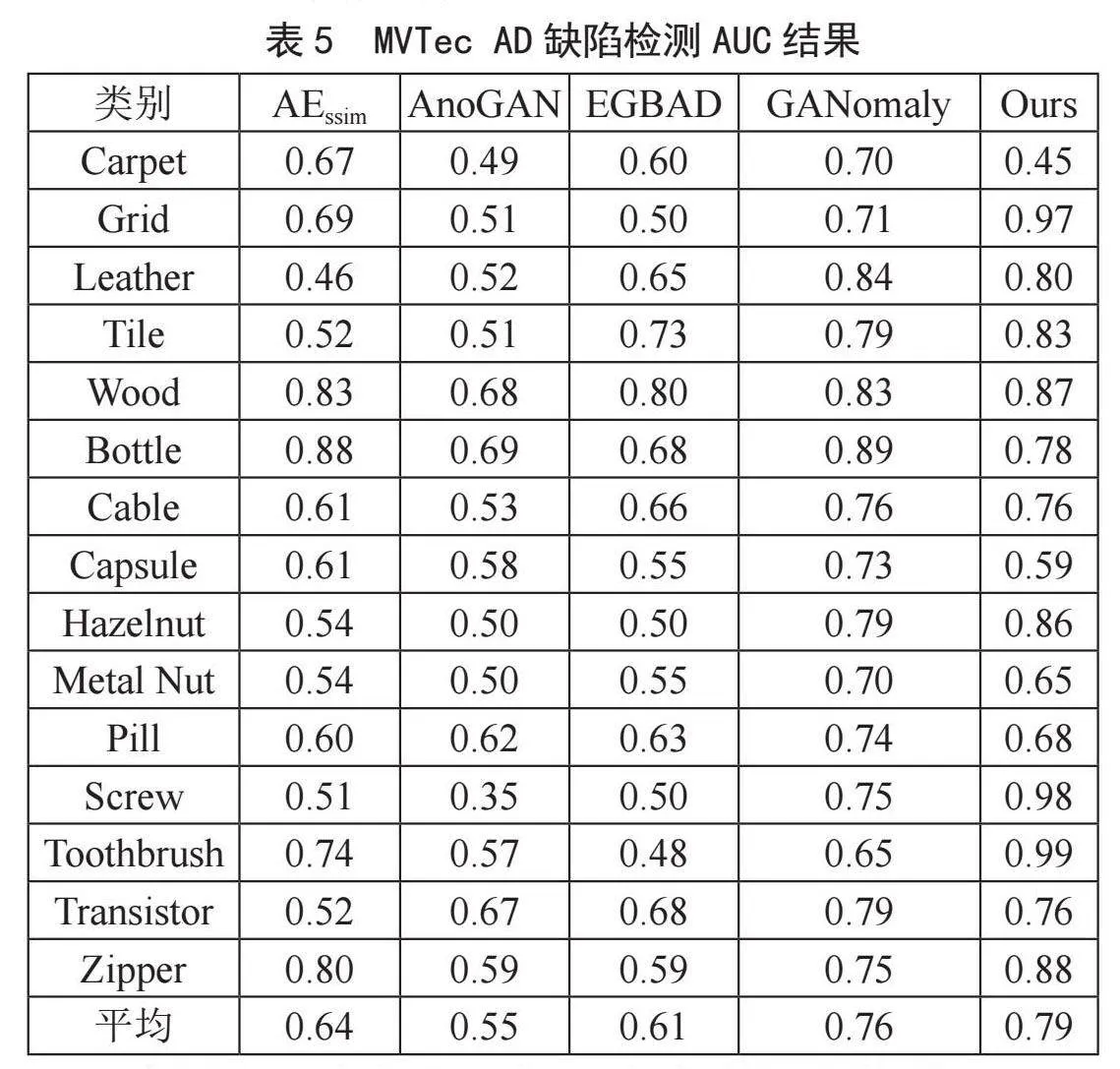

通过表3的数据可以直观地看出,跳层连接处CBAM注意力机制的引入,极大程度提高了模型的图像重构能力,AUC值相较于基准模型提高了3.3%,随着MemAE记忆模块的引入以及判别器D2的增添,AUC值相较于基准模型分别提高了5.5%和6.7%。为验证模型的有效性,本文同时也对公共数据集Mvtec AD数据集进行了实验,对比结果如表5所示。

分析表4中数据可知,本文所提出的基于改进生成对抗网络的晶圆表面缺陷检测模型在平均性能上都获得了较为优秀的检测性能,特别针对Screw、Toothbrush两类数据集,AUC值都得到了明显提高,而对于纹理类数据集Carpet由于较强的图像重构能力,无法达到有效的检测效果,整体平均AUC相较于基准模型Ganomaly提高了3%。

3 结 论

针对晶圆表面缺陷检测,为解决有监督学习获取标注数据昂贵、困难且缺乏先验知识的问题,提出了基于改进生成对抗网络的晶圆表面缺陷检测模型。在跳层连接处引入CBAM注意力机制帮助模型更好地关注图像的重要区域和重要特征;为约束潜在空间的表示从而引入记忆模块MemAE,使得重构后的图像样本分布接近正常样本。最后,在原模型架构上新增一个自动编码器架构判别器,以确保训练更稳定,更容易收敛到最佳平衡点。通过实验验证,本文所提出的模型对晶圆表面缺陷检测AUC值达到了0.985,相较于GANomlay提升了6.7%,在公共数据集MVTec AD上AUC值达到了0.79,相较于基准模型GANomaly提高了3%。证明该模型具有潜在价值,特别针对晶圆数据集能有效进行缺陷检测,对以后的晶圆表面缺陷检测任务具有一定的指导意义;对于公共数据集MVTec AD缺陷检测仍有一定的提升空间。

参考文献:

[1] 常凯,冯丽妃.我国半导体芯片制造底层技术短板待补 [N].中国科学报,2023-11-09(1).

[2] 曹芸玉.基于深度学习的晶圆表面缺陷检测系统研究 [D].郑州:华北水利水电大学,2023.

[3] JIN Q F,CHEN L. A Survey of Surface Defect Detection of Industrial Products Based on a Small Number of Labeled Data [J/OL].arXiv:2203.05733 [cs.CV].(2022-03-11).https://arxiv.org/abs/2203.05733.

[4] 刘世民.基于机器视觉的某低压断路器复杂纹理面板的瑕疵检测 [D].厦门:厦门理工学院,2022.

[5] 邱笑迎.基于颜色特征的面料花型图案检索算法 [J].计算机时代,2023(9):92-95.

[6] YANG W H. A Survey of Surface Defect Detection Based on Deep Learning [C]//2022 7th International Conference on Modern Management and Education Technology (MMET 2022).Dordrecht:Atlantis Press,2022:362-367.

[7] TAO X,GONG X Y,ZHANG X,et al. Deep Learning for Unsupervised Anomaly Localization in Industrial Images: A Survey [J].IEEE Transactions on Instrumentation and Measurement,2022,71:1-21.

[8] LEE D.Anomaly Detection in Multivariate Non-stationary Time Series for Automatic DBMS Diagnosis [J/OL].arXiv:1708.02635 [stat.ML].(2017-08-08).https://arxiv.org/abs/1708.02635.

[9] AKCAY S,ATAPOUR-ABARGHOUEI A,BRECKON T P. Ganomaly: Semi-supervised Anomaly Detection via Adversarial Training [C]//ACCV 2018:14th Asian Conference on Computer Vision.Perth:Springer,2019:622-637.

[10] YOUKACHEN S,RUCHANURUCKS M,PHATRAPOMNANT T,et al. Defect Segmentation of Hot-rolled Steel Strip Surface by Using Convolutional Auto-encoder and Conventional Image Processing [C]//2019 10th International Conference of Information and Communication Technology for Embedded Systems (ICICTES).Bangkok:IEEE,2019:1-5.

[11] YANG H,CHEN Y F,SONG K Y,et al. Multiscale Feature-clustering-based Fully Convolutional Autoencoder for Fast Accurate Visual Inspection of Texture Surface Defects [J].IEEE Transactions on Automation Science and Engineering,2019,16(3):1450-1467.

[12] WOO S,PARK J,LEE J-Y,et al. CBAM: Convolutional Block Attention Module [J/OL].arXiv:1807.06521 [cs.CV].(2018-07-17).https://arxiv.org/abs/1807.06521.

[13] GONG D,LIU L Q,LE V,et al.Memorizing Normality to Detect Anomaly: Memory-augmented Deep Autoencoder for Unsupervised Anomaly Detection [C]//2019 IEEE/CVF International Conference on Computer Vision (ICCV).Seoul:IEEE,2019:1705-1714.

[14] BERTHELOT D,SCHUMM T,METZ L. BEGAN: Boundary Equilibrium Generative Adversarial Networks [J/OL].arXiv:1703.10717 [cs.LG].(2017-03-31).https://arxiv.org/abs/1703.10717v4.

[15] HORÉ A,ZIOU D. Image Quality Metrics: PSNR vs. SSIM [C]//2010 20th International Conference on Pattern Recognition.Istanbul:IEEE,2010:2366-2369.

[16] BERGMANN P,FAUSER M,SATTLEGGER D,et al. MVTec AD—A Comprehensive Real-World Dataset for Unsupervised Anomaly Detection [C]//2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR).Long Beach:IEEE,2019:9584-9592.

作者简介:凌鸿伟(1999—),男,汉族,四川德阳人,硕士在读,研究方向:计算机视觉;通信作者:张建敏(1971—),女,汉族,湖北武汉人,教授,博士,研究方向:智能医疗与健康。