摘" 要:遥感图像变化检测技术作为一项重要的应用型技术,在地表变化监测领域有着广泛的应用。针对目前多数特征提取网络无法兼顾空间信息与语义信息的问题,以残差网络为基础,提出一种用于遥感图像变化检测的特征提取结构——CDResNet。使用该结构对不同时间的遥感图像进行特征提取,可以平衡所提取特征图中的空间信息和语义信息,还可以更准确地识别和定位图像中的变化区域。两个公共数据集上的实验验证了所提方法的鲁棒性和精确性。

关键词:遥感图像;变化检测;特征提取;网络架构

中图分类号:TP391.4;TP18 文献标识码:A" 文章编号:2096-4706(2024)11-0040-05

Improvement of Feature Extraction Network Structure for

Remote Sensing Image Change Detection

WANG Haozhen, YANG Lei, ZHANG Chuangye

(School of Information and Communication Engineering, Zhongyuan University of Technology, Zhengzhou" 450007, China)

Abstract: Remote sensing image change detection technology, as an important applied technology, has a wide range of applications in the field of surface change monitoring. Aiming at the problem that most current feature extraction networks cannot balance spatial and semantic information, a feature extraction structure called CDResNet is proposed for remote sensing image change detection based on residual networks. Using this structure for feature extraction of remote sensing images at different times can balance the spatial information and semantic information in the extracted feature maps, and more accurately identify and locate the changing regions in the image. The robustness and accuracy of the proposed method are validated through experiments on two public datasets.

Keywords: remote sensing image; change detection; feature extraction; network architecture

0" 引" 言

遥感图像变化检测通过比较同一空间在不同时间拍摄的图像,获取地物变化信息,在农业调查、土地利用等领域广泛应用[1,2]。卷积神经网络具有强大的识别能力,能够从每幅图像中提取关键的语义特征,从而判断当前区域是否发生变化。但是,要精确定位到发生变化的区域,则需要充足的空间信息[3]。然而,目前多数特征提取网络主干是在图像分类任务的主干上剪枝得到的,这类主干采用多次下采样操作,以获取在图像分类任务中至关重要的语义信息。该操作虽然获取了语义信息,但也损失了空间信息,这样的设计不利于变化检测性能的提升[4]。

针对当前基于深度学习的变化检测方法所采用的特征提取网络均为通用网络的现状,提出了一种专用于遥感图像变化检测的特征提取结构——CDResNet。

1" 常用的特征提取网络结构

1.1" VGG架构

VGG网络是一种具有较深结构的深度学习算法,用于图像分类任务。VGG网络在ImageNet挑战赛中取得优异成绩,这主要归功于其网络深度的增加[5]。VGG网络采用的3×3的小卷积核,这有利于提升网络的非线性表达能力,避免参数过多导致过拟合。VGG的输入通常为三通道图像,输出为一维向量,向量中单个元素值为当前图像是某一类别的概率。为了使其适用于变化检测任务删去了全连接层,使其输出变成通道数为512,大小为8×8的张量。

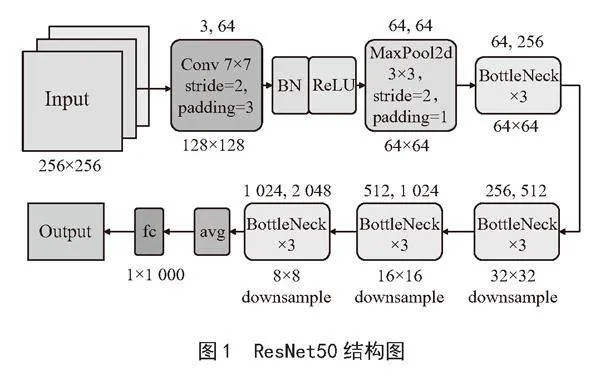

1.2" ResNet架构

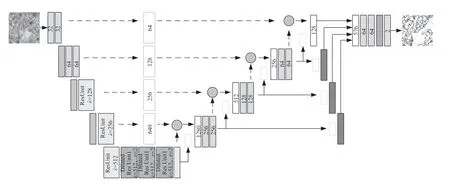

深度残差网络(Deep Residual Network, ResNet)通过引入残差结构来简化学习过程,使之面对更为复杂的网络结构时仍然具有良好的优化能力[6]。常用的ResNet有18层结构、34层结构以及50层结构。为增加变化检测精度,此处选取ResNet50为特征提取网络,其结构如图1所示,其中fc为全连接层,avg为平均池化层。ResNet通过由多个卷积层及恒等映射共同构成的“残差块”来进行残差关系的学习。在18层和34层中使用的残差块叫作BasicBlock。在50层以上的ResNet中叫作BottleNeck,在ResNet50中,共包含4个层级的BottleNeck。在与上一级BottleNeck相连的第一个残差块中使用Conv分支来调整通道数,而其他残差块使用shortcut分支进行恒等映射。若当前BottleNeck需要下采样时,该BottleNeck的第一个残差块的Conv分支将卷积的步距设为2进行下采样。残差学习范式使得学习过程更加简洁,并解决了梯度消失、梯度爆炸等问题。原始ResNet的输出为一维向量,为了适用于变化检测任务,去除了其为分类任务设置的全连接层。最终的输出张量为2 048×8×8。

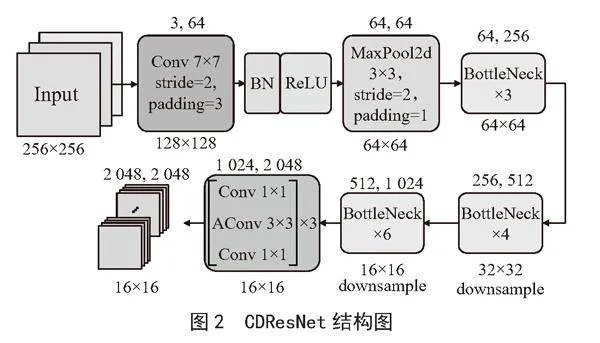

2" CDResNet网络结构

遥感图像与生活中普通图像的特征存在一些显著的差异。遥感图像通常具有更大的尺寸,因此包含更多的细节信息,而且数据量也通常比普通图像大得多[4]。但由于遥感图像成像距离被观测对象较远,因此空间分辨率不会特别高,例如常见的遥感图像中仅能辨析出建筑、道路和汽车等较大的物体。而普通图像往往具有更高的空间分辨率,图像中往往会出现更多的小目标。同时遥感图像中通常包含目标信息和大量的背景信息,例如地形、土地覆盖等,而普通图像可能更多地聚焦于人物、物体等,故背景信息较少。因此,在对遥感图像进行特征提取时可能需要考虑如何有效地区分目标和背景,防止背景信息干扰目标信息,这同样依赖充裕的空间与语义信息。

针对经典特征提取网络在遥感图像变化检测领域的不足,结合遥感图像的特点。在ResNet的基础上,设计了专用于遥感图像变化检测的特征提取网络——CDResNet。CDResNet网络结构如图2所示。所提出的网络与ResNet的最大区别在最后一级Bottleneck中。为了在得到语义信息的同时,保留足够的空间信息,从而准确地定位出发生变化的区域,CDResNet取消了最后一个残差块中的下采样操作,并且用间隔为1的空洞卷积层(Atrous Convolution, AConv)代替普通卷积层。在对遥感图像特征提取过程中,图像被送入CDResNet后先经过7×7卷积层,接下来通过批归一化层(Batch Normalization, BN)和线性激活单元(Rectified Linear Unit, ReLU),最后使用最大池化下采样完成对图像的预处理。然后经处理后的遥感数据经过三个普通的BottleNeck进行特征提取得到1 024×16×16的特征图,最后,经过所改进带有空洞卷积的BottleNeck进一步处理后,得到2 048×16×16带有丰富空间和语义信息的特征图。

3" 实验过程与结果分析

在本节中,将详述验证所提出模型有效性的过程。首先,介绍了实验数据集,包括CDD数据集和WHU数据集。然后,详述了实验实施的细节,包括实验设置以及评估指标。随后,对两个公共数据集的实验结果进行了定量分析。

3.1" 数据集介绍

3.1.1" CDD数据集

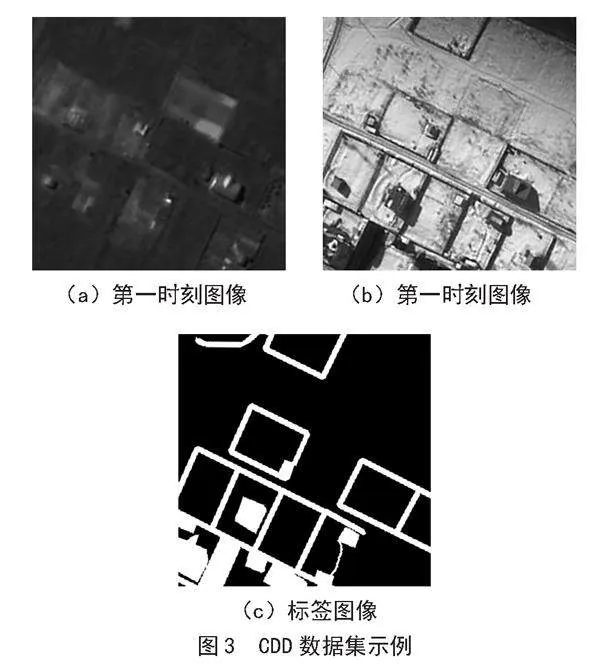

Change Detection Dataset(CDD)数据集由Lebedev等人在2018年提出,该数据集空间分辨率在0.03到1米/像素之间[7]。其由11对多光谱图像构成,其中7对不同季节的4 725×2 200的图像。包含无位移的合成图像、微小位移合成图像和不同季节真实遥感图像三种数据。本文使用了其中真实遥感数据,大小为256×256像素,包含16 000对双时相遥感图像,其中10 000对用于算法训练,3 000对用于验证样本,另外3 000对用作测试样本。图3为CDD数据集示例。

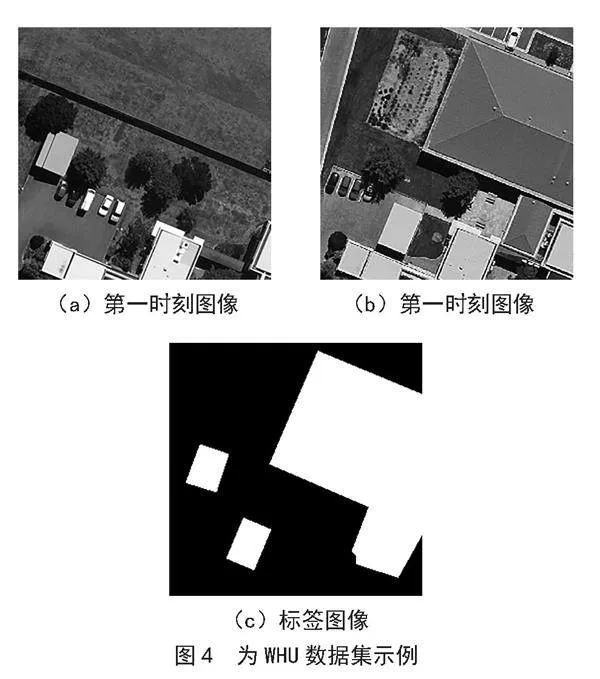

3.1.2" WHU数据集

WHU数据集由武汉大学提出,以建筑物的变化为重点,包括了约22 000座建筑物[8]。数据集中包含了2012年和2016年的两张航拍遥感RGB图像,每张图像的空间分辨率为0.075米/像素,裁剪成7 620个256×256像素的遥感图像块。数据集被分为6 096个训练集、762个验证集和762个测试集,以便于进行网络训练、验证和评估。WHU数据集为建筑物变化检测研究提供了重要的资源和平台,但由于存在光照和阴影等噪声,也对网络的处理能力提出了挑战。图4为WHU数据集示。

3.2" 实验环境

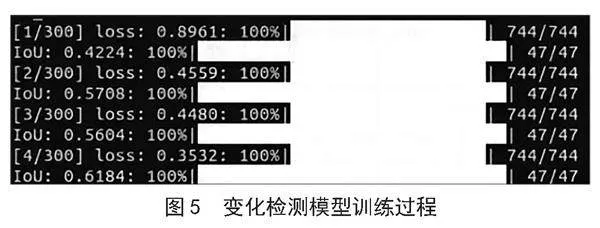

本次试验环境设定如下:利用Ubuntu 20.04.6 LTS操作系统作为平台,在PyTorch深度学习框架下用Python语言编写算法。在模型的训练及测试时,利用了一台装备了两块NVIDIA RTX 2080 Ti显卡的服务器完成。训练采用Adam优化算法、动量设置为0.9,将模型在所有数据集上的初始学习率皆调整至0.000 1。每个数据集的训练周期设定为300个Epoch。对于CDD数据集来说,选取单个批次大小为4;至于WHU选取的批次大小则为2,以确保能够达到网络精度与内存容量之间的平衡。模型训练过程如图5所示,训练数据输入神经网络,通过网络前向传播过程,得到输出结果并与标签进行比较,以衡量结果与标签的差异。接下来利用反向传播算法,得到网络参数梯度。最后使用优化算法根据反向传播得到的参数梯度更新神经网络的参数,至此便完成了一个训练周期。

3.3" 模型评价指标

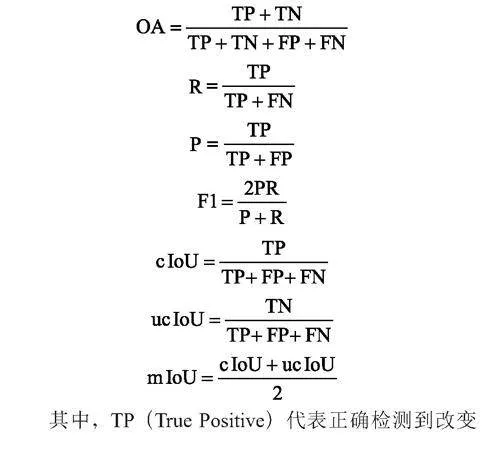

变化检测是确定像素的变化和未变化,可以看作是一个二分类问题。在实验中使用的评价指标有召回率(recall, R)、精确率(precision, P)、总体准确率(overall accuracy, OA)、F1分数(F1-score, F1)、变化区域交并比(Changed areas Intersection over Union, cIoU)、不变区域交并比(Unchanged areas Intersection over Union, ucIoU)和平均交并比(Mean Intersection over Union, mIoU)[9]。这些指标数值越大,模型效果越好。这些指标的计算公式如下:

其中,TP(True Positive)代表正确检测到改变的像素点的数量,TN(True Negative)代表正确检测到无改变的像素点的数量,FN(False Negative)代表实际发生改变但未被检测到改变的像素点数量,FP(False Positive)代表实际上没有改变但被检测为发生改变的像素数量。

3.4" 实验结果与分析

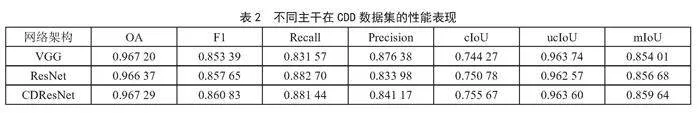

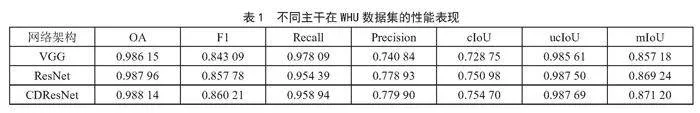

在CDD和WHU数据集上,使用两种变化检测方法进行比较,并进行结果的定量分析。为确保结果的准确和公平,用相同的训练、验证集来训练所有模型,并采用相同的测试集进行测试[10]。每种方法在每个数据集上的评估结果如表1所示。

3.4.1" 在WHU数据集上的对比

不同方法在WHU数据集上的定量结果如表1所示。从表中可以得出,所提出的方法在OA、F1、Precision、cIoU、ucIoU和mIoU上均取得了最佳的性能,分别达到了98.81%、86.02%、77.99%、75.47%、98.77%和87.12%。尽管所提出的方法的Recall指标较差,但这是为平衡Precision而造成的。在综合评价Recall和Precision的F1指标上,本文的方法仍然取得了最好的成绩。

3.4.2" 在CDD数据集上的对比

CDD与WHU数据集不同,CDD数据集包含多种变化类型而不仅针对建筑的变化。因此其负样本(未变化类像素)和正样本(变化类像素)的不均衡率更低,变化检测难度更低。在CDD数据集上所提出方法在cIoU与F1这两个重要指标上,有较大幅度领先,在整体精度上有小幅度领先。不同主干在CDD数据集的性能表现如表2所示。

4" 结" 论

当前主流的特征提取网络结构主要基于图像分类任务设计,这种设计虽然有利于获取丰富的语义信息,但损失了空间信息,影响了变化检测性能的提升。为了解决这一问题,本文提出了一种专用于遥感图像变化检测的特征提取结构——CDResNet。该结构在保持语义信息提取能力的同时,兼顾了图像中的空间信息,实现了对变化区域的精确定位。实验结果表明,CDResNet在遥感图像变化检测任务中具有优异的性能,相较于主流方法,能够更准确地检测出变化区域。未来的研究方向可以进一步探索和改进CDResNet结构,结合迁移学习、注意力机制等,进一步提高变化检测的准确性。

参考文献:

[1] WEN D W,HUANG X,BOVOLO F,et al. Change Detection From Very-High-Spatial-Resolution Optical Remote Sensing Images: Methods, Applications, and Future Directions [J].IEEE Geoscience and Remote Sensing Magazine,2021,9(4):68–101.

[2] JIANG H W,PENG M,ZHONG Y J,et al. A Survey on Deep Learning-Based Change Detection from High-Resolution Remote Sensing Images [J].Remote Sensing,2022,14(7):1552-1552.

[3] SHAFIQUE A,CAO G,KHAN Z,et al. Deep Learning-Based Change Detection in Remote Sensing Images: A Review [J].Remote Sensing,2022,14(4):871-871.

[4] SHI W Z,ZHANG M,ZHANG R,et al. Change Detection Based on Artificial Intelligence: State-of-the-Art and Challenges [J].Remote Sensing,2020,12(10):1688-1688.

[5] SIMONYAN K,ZISSERMAN A. Very Deep Convolutional Networks for Large-Scale Image Recognition [J/OL].arXiv:1409.1556 [cs.CV].[2023-09-06].https://arxiv.org/abs/1409.1556.

[6] HE K M,ZHANG X Y,REN S Q,et al. Deep Residual Learning for Image Recognition [C]//2016 IEEE Conference on Computer Vision and Pattern Recognition(CVPR).Las Vegas:IEEE,2016:770-778.

[7] LEBEDEV M A,VIZILTER Y V,VYGOLOV O V,et al. Change Detection in Remote Sensing Images Using Conditional Adversarial Networks [J].The International Archives of the Photogrammetry,Remote Sensing and Spatial Information Sciences,2018,XLII-2:565-571.

[8] JI S P,WEI S Q,LU M. Fully Convolutional Networks for Multisource Building Extraction From an Open Aerial and Satellite Imagery Data Set [J].IEEE Transactions on Geoscience and Remote Sensing,2019,57(1):574-586.

[9] 简玉琳.针对不平衡数据集分类问题关键技术及其应用研究 [D].成都:电子科技大学,2021.

[10] LI Q Y,ZHONG R F,DU X,et al. TransUNetCD: A Hybrid Transformer Network for Change Detection in Optical Remote-Sensing Images [J].IEEE Transactions on Geoscience and Remote Sensing,2022,60:1-19.

作者简介:王浩震(1997—),男,汉族,河南鹤壁人,硕士研究生在读,主要研究方向:计算机视觉、深度学习;杨蕾(1979—),女,回族,河南洛阳人,教授,博士,主要研究方向:图像处理、计算机视觉;张创业(1998—),男,汉族,河南周口人,硕士研究生在读,主要研究方向:计算机视觉、深度学习。

收稿日期:2024-03-11

基金项目:中原科技创新领军人才(214200510013);校内重大项目成果培育计划(K2020ZDPY02)