摘" 要:随着数据隐私保护需求的不断增加,联邦学习作为一种分布式机器学习方法,能够在不集中数据的情况下进行模型训练。而联邦学习仍面临参与方数据在模型训练过程中泄露的风险。为解决这一问题,文章提出了一种基于全同态加密的联邦学习隐私保护技术。通过在联邦学习的模型参数聚合阶段引入全同态加密技术,使得参数计算和更新均在加密态下完成,从而确保了参与方数据的隐私安全。同时设计了一个高效的隐私保护框架,并在多个公开数据集上进行了实验验证。实验结果表明,所提出的联邦学习框架不仅保证了模型准确性,也提高了数据隐私保护的安全性和计算效率。

关键词:联邦学习;全同态加密;隐私保护;分布式机器学习;数据安全

中图分类号:TP309" 文献标识码:A" 文章编号:2096-4706(2024)23-0170-05

Research on Privacy Protection Technology for Federated Learning Based on Fully Homomorphic Encryption

LI Qiuxian, ZHOU Quanxing

(Kaili University, Kaili" 556011, China)

Abstract: With the increasing demand for data privacy protection, Federated Learning could conduct the model training without centralizing data as a Distributed Machine Learning method. However, Federated Learning still faces the risk of participant data leakage in the process of model training. To address this issue, this paper proposes a privacy protection technique for Federated Learning based on Fully Homomorphic Encryption. By introducing FHE technology into the model parameter aggregation phase of Federated Learning, the parameter computation and updates are performed in an encrypted state, so as to ensure the privacy security of the participant data. At the same time, this paper designs an efficient privacy protection framework and conducts experimental validation on multiple public datasets. The experimental results show that the proposed Federated Learning framework not only ensures the accuracy of the model, but also improves the security and computing efficiency of data privacy protection.

Keywords: Federated Learning; Fully Homomorphic Encryption; privacy protection; Distributed Machine Learning; data security

0" 引" 言

随着信息技术的迅猛发展和数据应用的日益普及,数据隐私保护问题逐渐成为学术界和工业界关注的焦点[1]。传统的集中式机器学习方法需要将数据集中存储和处理,这不仅增加了数据泄露的风险,还在一定程度上违背了隐私保护的基本原则[2]。为了解决这一问题,谷歌首次提出了联邦学习(Federated Learning, FL)的概念[3]。联邦学习是一种分布式机器学习方法,通过在各参与方本地数据上训练模型,并将本地训练的模型参数发送至中央服务器进行聚合更新,从而实现全局模型的训练[4-5]。这样,数据无须离开本地,从而在一定程度上保护了数据隐私[6]。

尽管联邦学习有效地降低了数据集中存储的隐私风险,但在模型参数交换过程中,参与方的数据仍可能被恶意攻击者窃取或推断[7]。现有的隐私保护技术如差分隐私[8](Differential Privacy, DP)和多方安全计算[9](Secure Multi-Party Computation, SMPC),虽然在一定程度上提高了数据安全性,但在应用于联邦学习时,往往面临计算复杂度高、通信开销大以及模型精度降低等问题[10]。因此,探索高效且安全的隐私保护技术以保障联邦学习过程中的数据隐私显得尤为重要[11]。

全同态加密[12](Fully Homomorphic Encryption, FHE)作为一种新兴的加密技术,具有在加密态下直接执行计算的独特优势。全同态加密允许在不解密数据的情况下进行各种算术操作,从而在确保数据隐私的前提下完成计算任务[13]。OU等人[14]针对贝叶斯机器学习,设计了一个基于同态加密的垂直联邦学习系统,该系统训练出的模型与单个联合服务器训练出的模型相当。MADI等人[15]通过结合同态加密 和可验证计算技术来实现聚合模型的安全性,以便直接在加密域中执行联邦平均运算符并生成正确应用运算符的正式证明。MA等人[16]提出了MK-CKKS多密钥同态加密协议的改进版本,设计了一种新颖的隐私保护联邦学习方案,在该方案中,模型更新在与服务器共享以进行聚合之前通过聚合公钥加密。HIJAZI等人[17]提出了四种不同的基于联邦学习的全同态加密方法,其中数据被加密并通过安全介质传输。所提出的方法除了提供强大的隐私和安全保障外,还实现了高准确率、召回率、精确率和F值。将全同态加密技术引入联邦学习,能够在不泄露参与方数据的情况下,完成模型参数的计算和更新,从而提供了一种有效的数据隐私保护方案[18]。

综上所述,本研究旨在探讨基于全同态加密的联邦学习隐私保护技术,通过在联邦学习的模型参数聚合阶段引入全同态加密极速,使得参数计算和模型更新均在加密态下进行,从而确保参与方数据的隐私安全。本文设计并实现了一个高效的隐私保护框架,并在多个公开数据集上进行了实验验证。实验结果表明,所提出的方法在保证模型准确性的同时,显著提高了数据隐私保护的安全性和计算效率。

1" 预备知识

1.1" 全同态加密

全同态加密是一种密码学技术,允许在不解密数据的情况下直接对加密数据进行算术操作。全同态加密的基本思想是对加密数据进行操作,其结果与对明文数据进行相同操作后再加密的结果相同,从而在确保数据隐私的前提下完成计算任务。形式化定义如下:

设E(m)表示消息m的加密形式,⊕和⊗分别表示加密态下的加法和乘法运算。全同态加密满足以下性质:

加法同态性:E(m1)⊕E(m2) = E(m1+m2)

乘法同态性:E(m1)⊗E(m2) = E(m1×m2)

其中,m1和m2为明文数据。

1.2" 联邦学习

联邦学习是一种新兴的分布式机器学习方法,其思想是通过在各参与方本地数据上独立训练模型,然后将本地模型参数发送至中央服务器进行聚合更新,从而在不需要共享数据的情况下构建全局模型。形式化定义如下:

假设有K个参与方,每个参与方k持有本地数据集Dk,全局模型的目标是最小化全局损失函数:

其中,w为模型参数,Fk(w)为参与方k的本地损失函数,Dk为参与方k的数据集大小,D为所有参与方数据集的总大小。

在每一轮迭代中,联邦学习的具体过程如下:

本地训练:每个参与方k使用本地数据集Dk训练模型,并且更新本地模型参数wk:

其中,η为学习率,∇Fk(w(t))为本地损失函数的梯度。

参数上传:每个参与方将更新后的本地模型参数 上传至中央服务器。

全局聚合:中央服务器接收所有参与方上传的本地模型参数,并进行加权平均以更新全局模型参数w:

模型下发:中央服务器将更新后的全局模型参数w(t+1)发送回各参与方,开始新一轮的本地训练。

2" 联邦学习隐私保护框架

为了确保在联邦学习过程中参与方的数据隐私安全,本文提出了一种基于全同态加密的隐私保护框架。该框架包括三个主要阶段:初始化阶段、聚合阶段和解密阶段。

2.1" 初始化阶段

在初始化阶段,联邦学习的参与方和中央服务器需要生成公钥和私钥,并分发公钥。每个参与方对其本地模型参数进行加密,然后将加密后的参数上传到中央服务器。

密钥生成:中央服务器运行密钥生成算法生成全同态加密方案的公钥pk和私钥sk,并将公钥pk分发给所有参与方。可形式化为(pk,sk)⟵KeyGen(1λ),其中λ为安全参数,用于增加加密的安全强度。

本地模型训练与加密:每个参与方k在本地数据集Dk上训练模型,得到本地模型参数wk。然后,使用公钥pk对本地模型参数wk进行加密:E(wk)=Encpk(wk),其中Encpk(wk)为使用公钥pk进行加密的操作。

参数上传:每个参与方将加密后的本地模型参数E(wk)上传至中央服务器:Send(E(wk))⟶Central Server。

2.2" 聚合阶段

在聚合阶段,中央服务器接收所有参与方上传的加密模型参数,并在加密态下对这些参数进行聚合计算,生成全局模型参数。

加密参数接收:中央服务器接收所有参与方上传的加密模型参数E(wk),即。

加权平均聚合:中央服务器使用全同态加密算法对加密参数进行加权平均聚合。假设Dk为参与方k的数据集大小,D为所有参与方数据集的总大小,则全局模型参数E(wg)的计算为:

由于全同态加密的加法同态性,可以直接在加密态下进行加权求和:

参数加密结果:聚合后的加密全局模型参数E(wg)由中央服务器存储,以供解密阶段使用。

2.3" 解密阶段

在解密阶段,中央服务器将聚合后的加密模型参数发送给各参与方,各参与方使用私钥对其进行解密,获得更新后的全局模型参数。

参数分发:中央服务器将聚合后的全局模型参数E(wg)发送给各参与方:

参数解密:每个参与方使用私钥sk对接收到的加密全局模型参数E(wg)进行解密,获得更新后的全局模型参数wg = Decsk(E(wg)),其中Decsk为使用私钥sk进行解密的操作。

本地模型更新:每个参与方使用解密后的全局模型参数wg更新其本地模型参数,并开始新一轮的本地训练:。

3" 安全性证明

为保证本文提出的基于全同态加密的联邦学习隐私保护框架的安全性,本节将从两个方面进行详细的安全性证明,包括参与方数据的隐私性和中央服务器的安全性。

3.1" 参与方数据隐私性

本文提出的基于全同态加密的联邦学习隐私保护框架参与方数据具有隐私性。

在联邦学习过程中,参与方的数据隐私性主要体现在本地模型参数的加密和传输过程中。通过全同态加密技术,确保本地模型参数wk在传输过程中始终保持加密态E(wk),即使在传输过程中被截获,攻击者也无法获取明文数据。

假设存在恶意攻击者能够截获加密后的本地模型参数E(wk),由于全同态加密方案的安全性,恶意攻击者无法在多项式时间内从E(wk)中恢复出明文wk。对于任何多项式时间存在恶意攻击者,其成功概率Pr[(E(wk))=wk]是可忽略的,即:Pr[(Ewk))=wk]≤ϵ(λ),其中ϵ(λ)为随安全参数λ增长的可忽略函数。因此,本文提出的基于全同态加密的联邦学习隐私保护框架中的参与方数据具有隐私性。

3.2" 中央服务器的安全性

本文提出的基于全同态加密的联邦学习隐私保护框架的中央服务器具有安全性。

中央服务器在接收到所有参与方上传的加密模型参数后,进行加密态下的加权平均聚合,生成全局模型参数E(wg),由于整个计算过程在加密态下进行,中央服务器无法获取参与方的明文数据。

在加密态下进行加权平均聚合计算,确保中央服务器无法解密和访问明文模型参数。中央服务器对加密模型参数进行加权平均聚合计算,得到E(wg),即:

由于全同态加密的加法同态性,中央服务器无法从E(wg)中恢复出明文模型参数。因此,本文提出的基于全同态加密的联邦学习隐私保护框架的中央服务器也具有安全性。

4" 实验

4.1" 实验设置

本实验选择了MNIST手写数字识别数据集和CIFAR-10图像分类数据集进行实验,这些数据集广泛用于机器学习和深度学习的研究,具有代表性。实验在具备高性能计算能力的服务器上进行,配置包括Intel Xeon E5-2680 v4处理器、256 GB内存和Ubuntu 20.04操作系统,并使用HElib库实现全同态加密。模型架构采用经典的卷积神经网络(CNN),对于MNIST数据集,使用两层卷积层和两层全连接层的模型;对于CIFAR-10数据集,使用三层卷积层和两层全连接层的模型。实验参数包括学习率0.01、批次大小64、训练轮数10轮,加密参数选择安全参数λ = 80,密钥大小为1 024位。评估指标采用准确率、加密和解密时间、通信开销和计算开销。

4.2" 实验结果分析

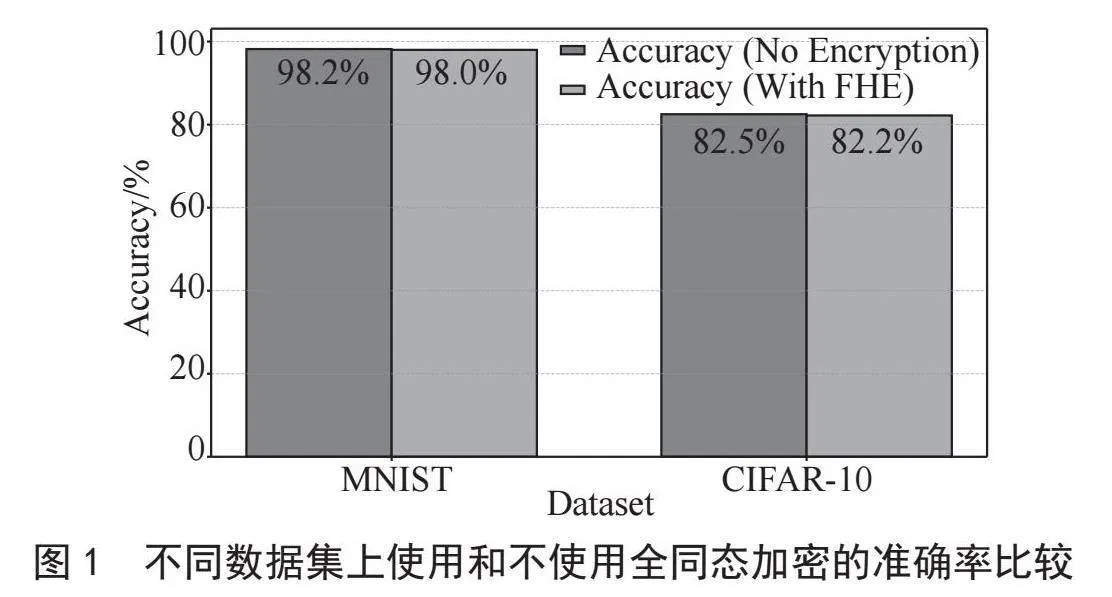

首先,在不同数据集上,比较了使用全同态加密和不使用全同态加密的模型准确率,实验结果如图1所示。

图1展示了在MNIST和CIFAR-10数据集上,不使用加密和使用全同态加密的模型准确率。实验结果表明,尽管使用全同态加密会略微降低模型训练的准确率,但整体影响不大,模型仍能保持较高的准确率。这验证了全同态加密在不显著影响模型性能的前提下,有效保护了数据隐私。

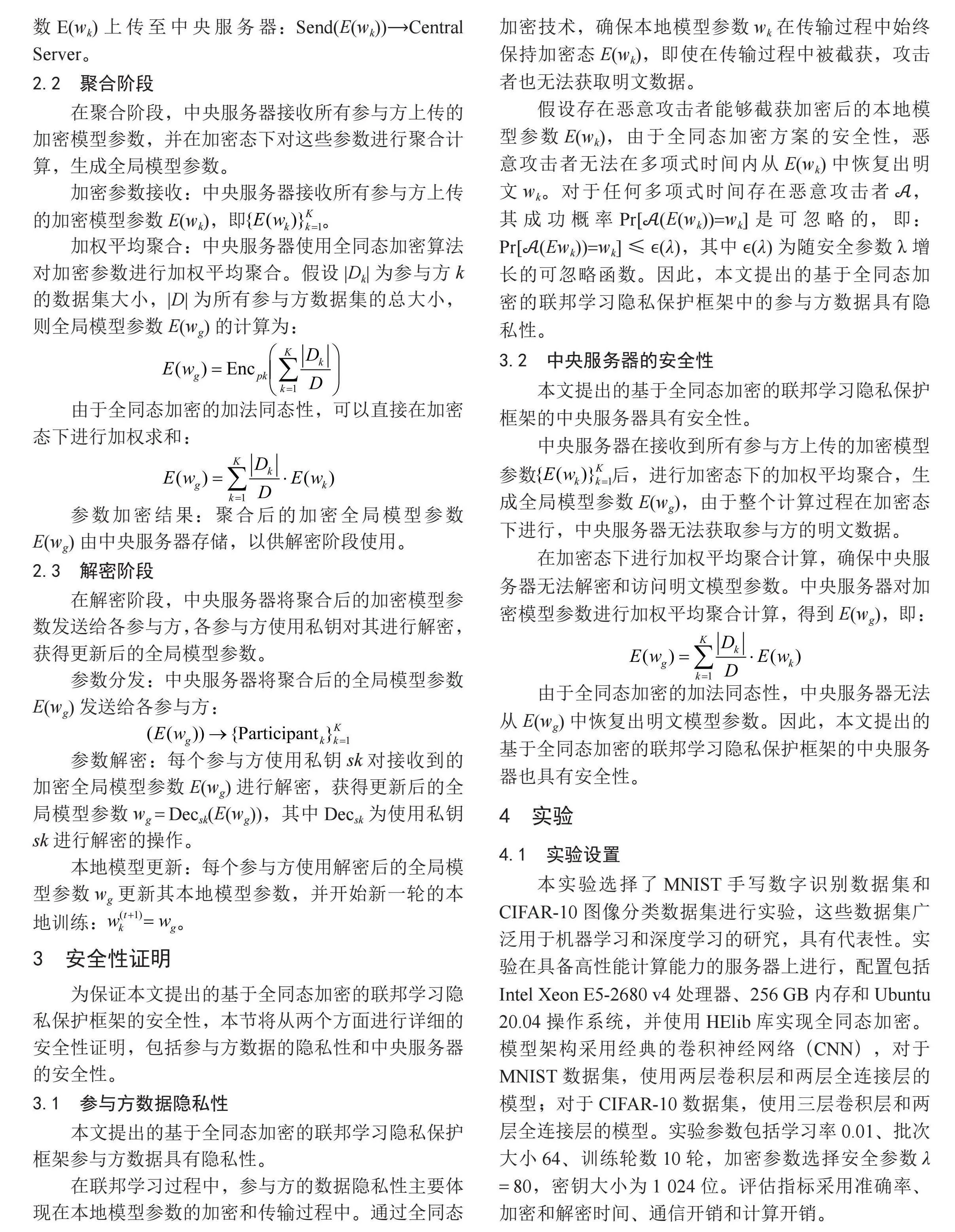

接着,通过模拟实验评估在全同态加密下联邦学习各节点训练模型任务的平均通信开销,分析不同节点的平均通信开销,比较在不同数据批大小下的通信开销变化,实验结果如图2所示。

图2展示了在不同数据批大小下,不使用加密和使用全同态加密的节点的平均通信开销。由图可知,随着数据批大小的增加,各节点的平均通信开销也逐渐增多。然而,使用全同态加密的节点在整个实验中的平均通信开销略高于不使用加密的节点。尽管如此,这种增加的通信开销在可接受范围内,能够为隐私保护提供有效保障。

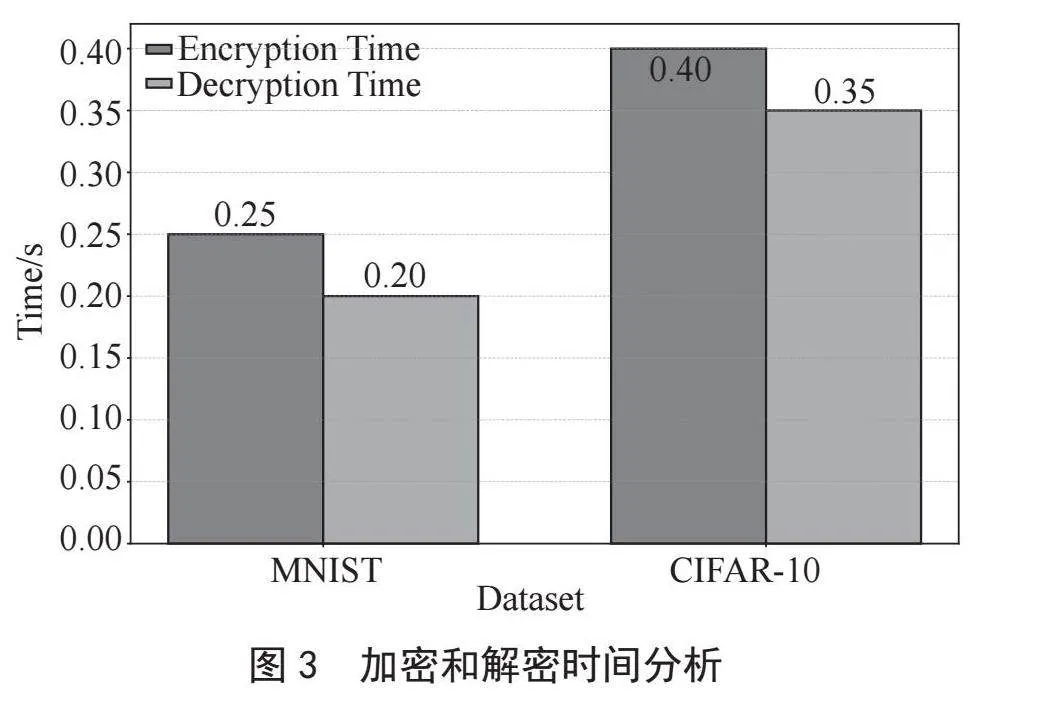

最后,对本框架在MNIST和CIFAR-10数据集上,每轮训练的加密和解密时间进行实验分析对比,实验结果如图3所示。

由图3可知,随着数据集的复杂性增加,加密和解密时间也有所增加。具体而言,MNIST数据集的加密时间为0.25 s,解密时间为0.20 s;CIFAR-10数据集的加密时间为0.40 s,解密时间为0.35 s。结果表明基于全同态加密的联邦学习框架在保证数据隐私的前提下,具有较好的计算效率和可行性。

5" 结" 论

本文提出了一种基于全同态加密的联邦学习隐私保护技术,通过在联邦学习的模型参数聚合阶段引入全同态加密技术,实现了参数计算和更新均在加密态下完成,从而确保了参与方数据的隐私安全。通过实验分析,所提出的隐私保护框架在保证模型准确性的同时,显著提高了数据隐私保护的安全性和计算效率。在MNIST和CIFAR-10数据集上的实验验证了该框架的有效性和可行性,尽管在通信开销和计算开销上有所增加,但这些开销在可接受范围内。下一步的工作将集中在进一步优化全同态加密算法,以减少计算和通信开销,同时保持模型框架的安全性和准确性。

参考文献:

[1] BINJUBEIR M,AHMED A A,ISMAIL M A B,et al. Comprehensive Survey on Big Data Privacy Protection [J].IEEE Access,2019,8:20067-20079.

[2] YANG P,XIONG N X,REN J L. Data Security and Privacy Protection for Cloud Storage: A Survey [J].IEEE Access,2020,8:131723-131740.

[3] KAIROUZ P,MCMAHAN H B,AVENT B,et al. Advances and Open Problems in Federated Learning [J].Foundations and trends® in machine learning,2021,14(1-2):1-210.

[4] ZHANG C,XIE Y,BAI H,et al. A Survey on Federated Learning [J].Knowledge-Based Systems,2021,216:1-11.

[5] 方晨,郭渊博,王一丰,等.基于区块链和联邦学习的边缘计算隐私保护方法 [J].通信学报,2021,42(11):28-40.

[6] 李荣昌,刘涛,郑海斌,等.基于最大最小策略的纵向联邦学习隐私保护方法 [J].自动化学报,2024,50(7):1373-1388.

[7] YIN X F,ZHU Y M,HU J K. A Comprehensive Survey of Privacy-Preserving Federated Learning: A Taxonomy Review and Future Directions [J].ACM Computing Surveys,2022,54(6):1-36.

[8] WEI K,LI J,DING M,et al. Federated Learning With Differential Privacy: Algorithms and Performance Analysis [J].IEEE transactions on information forensics and security,2020,15:3454-3469.

[9] KNOTT B,VENKATARAMAN S,HANNUN A,et al. Crypten: Secure Multi-Party Computation Meets Machine Learning [J/OL].arXiv:2109.00984[cs.LG].[2024-05-08].https://arxiv.org/abs/2109.00984?context=cs.CR.

[10] LI Q L,WEN Z Y,WU Z M,et al. A Survey on Federated Learning Systems: Vision Hype and Reality for Data Privacy and Protection [J].IEEE Transactions on Knowledge and Data Engineering,2023,35(4):3347-3366.

[11] LYU L J,YU H,MA X J,et al. Privacy and Robustness in Federated Learning: Attacks and Defenses [J].IEEE transactions on neural networks and learning systems,2024,35(7):8726-8746.

[12] YOUSUF H,LAHZI M,SALLOUM S A,et al. Systematic Review on Fully Homomorphic Encryption Scheme and Its Application [J].Recent Advances in Intelligent Systems and Smart Applications,2020:537-551.

[13] 戴怡然,张江,向斌武,等.全同态加密技术的研究现状及发展路线综述 [J].电子与信息学报,2024,46(5):1774-1789.

[14] OU W,ZENG J H,GUO Z J,et al. A Homomorphic-Encryption-Based Vertical Federated Learning Scheme for Rick Management [J].Computer Science and Information Systems,2020,17(3):819-834.

[15] MADI A,STAN O,MAYOUE A,et al. A Secure Federated Learning Framework Using Homomorphic Encryption and Verifiable Computing [C]//2021 Reconciling Data Analytics Automation Privacy and Security:A Big Data Challenge (RDAAPS).Hamilton:IEEE,2021:1-8.

[16] MA J,NAAS S A,SIGG S,et al. Privacy‐Preserving Federated Learning Based on Multi-Key Homomorphic Encryption [J].International Journal of Intelligent Systems,2022,37(9):5880-5901.

[17] HIJAZI N M,ALOQAILY M,GUIZANI M,et al. Secure Federated Learning With Fully Homomorphic Encryption for IoT Communications [J].IEEE Internet of Things Journal,2024,11(3):4289-4300.

[18] ZHANG L,XU J B,VIJAYAKUMAR P,et al. Homomorphic Encryption-Based Privacy-Preserving Federated Learning in IoT-Enabled Healthcare System [J].IEEE Transactions on Network Science and Engineering,2022,10(5):2864-2880.

作者简介:李秋贤(1992—),女,汉族,河南焦作人,讲师,硕士,主要研究方向:信息安全、博弈论;周全兴(1987—),男,汉族,贵州遵义人,副教授,学士,主要研究方向:区块链、联邦学习。