陈秋叶 韦瑞华 石璐莹 吴甜 刘海华

摘 要:针对CT图像中全心脏结构复杂度高、分割不完整及分割精度低等问题,文章提出了一种改进U-Net的全心脏分割方法。根据全心脏结构形态特点,文章将多并行尺度特征融合模块引入U-Net网络的编码层,并在U-Net网络的跳层连接中加入了注意力机制。文章利用MM-WHS数据集将改进的全心脏分割算法在中南民族大学认知科学实验室中进行了一系列的全心脏分割实验。实验结果显示,文章提出的算法分割相似度达到88.73%,提高了全心脏结构的分割准确率。

关键词:全心脏CT图像分割;改进U-Net网络;多并行尺度特征融合;注意力机制

中图分类号:TP391 文献标识码:A文章编号:2096-4706(2021)13-0076-05

Whole-heart CT Image Segmentation Based on Improved U-Net

CHEN Qiuye, WEI Ruihua, SHI Luying, WU Tian, LIU Haihua

(South-Central Minzu University, Wuhan 430074, China)

Abstract: Aiming at the problems of high structural complexity, incomplete segmentation and low segmentation accuracy of whole heart in CT images, the paper proposes a whole-heart segmentation method based on improved U-Net. According to the structural and morphological characteristics of the whole heart, multi-parallel scale feature fusion module is introduced into the coding layer of U-Net network, and attention mechanism is added into the skipping layer of U-Net network. A series of whole heart segmentation experiments are carried out in the Cognitive Science Laboratory of South-Central University for Nationalities using the improved whole heart segmentation algorithm based on the MM-WHS dataset. Experimental results show that the similarity of the proposed algorithm reaches 88.73%, which improves the segmentation accuracy of the whole heart structure.

Keywords: whole heart CT image segmentation; improved U-Net network; multi parallel scale feature fusion; attention mechanism

0 引 言

心血管系统是人体的循环系统,它承担着为人体输送营养物质、排出代谢废物进而维持人体正常生命体征的重要作用。基于医学影像的自动分割在提高医生手术准确率和高效性等方面具有突出优势,特别在心脏介入手术中,全心脏结构的精准分割有助于提高精准治疗。另外,随着社会的发展,心血管疾病的发病率和致死率越来越高,并且发病越来越年轻化[1]。因此,心血管疾病的及时诊断与治疗显得尤为重要,而全心脏结构的精准分割对于心血管疾病的诊疗有着重要的意义。因此,全心脏结构的自动精准分割是一项重要的研究课题。

1 相关研究

CT影像中全心脏结构的分割一直是医学图像分割领域的一个热点话题。目前针对心脏图像的分割已有大量的方法被提出,这些方法涉及传统方法中的图谱法、可形变模型以及近年来发展火热的深度学习的方法[2]。图谱法和可形变模型都是基于先验模型的方法,这两种方法都是先通过某些特征如harr特征[3]找到CT影像中心脏的中心和粗略的分割边界,然后通过图谱法或可形变模型进行配准进而得到心脏的分割结果。在MM-WHS 2017挑战赛中出现了很多用深度学习进行全心脏分割的方法,Christian等[4]通过一个定位CNN网络和一个分割CNN网络将全心脏结构分割出来,并取得了MM-WHS 2017挑战赛第一名的成绩。Yang等[5]使用带有深度监督的3D U-Net网络,并使用了将交叉熵损失和Dice损失融合的新型损失,在MM-WHS 2017挑战赛中也取得了很好的分割结果。在比赛结束后,Xu等[6]先通过Fast RCNN定位全心脏结构,然后使用U-Net网络分割出全心脏结构,分割结果不逊于MM-WHS 2017挑战赛冠军的成绩。但是相比于其他器官或肿瘤组织的分割,全心脏结构直径范围比较广,各部位对比度变化不明显,且易受其他组织结构、病变、噪声等因素的干扰。针对这些现存问题,本文结合最新的理论基础致力于实现更精准的全心脏CT图像自动分割。

2 网络结构

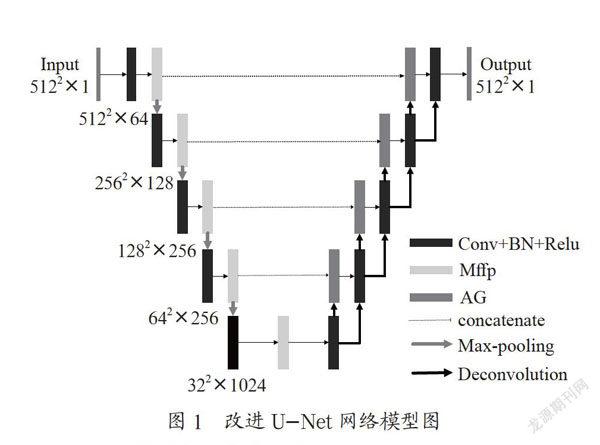

本文提出了一种集多并行尺度特征融合、注意力机制为一体的改进U-Net全心脏结构分割网络,该网络结构充分利用了数据低维特征与高维特征、局部信息与全局信息,进而有效改进了网络的分割效能。基于改进U-Net网络分割模型见图1。

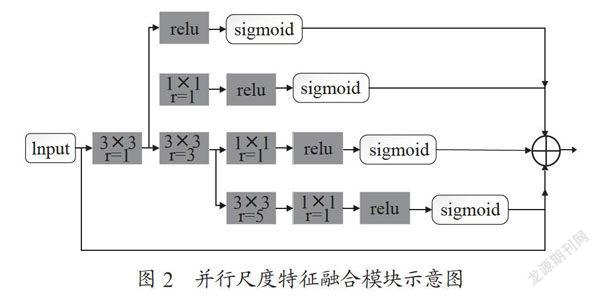

2.1 多并行尺度特征融合

在卷积神经网络中,浅层特征提取的是全局的粗糙信息,深层特征提取的是精细的细节信息,深层和浅层特征的融合可以提升分割效果。但是随着网络深度的加深很多细节信息都流失了,而并行尺度特征融合(Mffp)利用不同空洞率(r)的空洞卷积[7]并行并融合的方式提取心脏不同结构的特征信息。这种做法既可以识别出不同结构的特征,而且也可以识别出微小动脉血管的细节信息,对于对比度低的心脏结构以及狭小的动脉血管有较好的分割效果。在编码结构的每一层卷积后都添加一个并行尺度特征融合从而构成多并行尺度特征融合[8],该模块可以充分利用因为卷积而丢失的深层和浅层特征,进而对分割结果进行优化。

并行尺度特征融合(Mffp)包括空洞率从1到5奇数增加的四条空洞分支和一条原特征图分支,然后将不同空洞率产生的特征图与原特征图进行融合,四条空洞卷积的分支在融合之前都经过了sigmoid激活函数。该模块的结构示意图如图2所示。

本文分别将并行尺度特征融合添加到编码层的第1层卷积(conv1_Mffp)、第2层卷积(conv2_Mffp)、第3层卷积(conv3_Mffp)、第4层卷积(conv4_Mffp)、最底层卷积(conv5_Mffp)以及1到5层卷积的每一层(conv1_5_Mffp)进行对比试验。

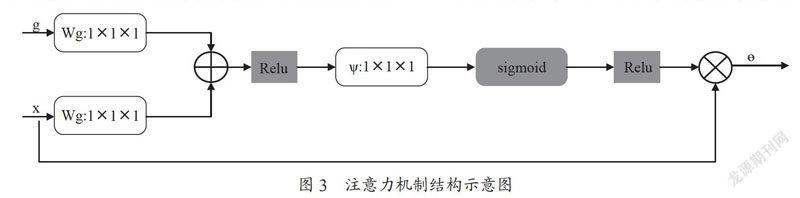

2.2 注意力机制模型

因为一系列的卷积和池化操作会过滤掉一些必要的边缘信息并带入一些多余的噪声信息,所以本文在跳层连接中加入了注意力机制(AG)[9]。注意力机制的结构如图3所示。

其中x是编码器相应网络层的输出特征图,g是与编码器对应的同层解码器网络下一层的特征输出,θ是注意力机制的门相关系数,T是注意力机制的输出。在编码结构中,注意力机制通过分析编码器输出特征图和解码器的输出特征图以获得相应的门相关系数,从而使注意力机制更专注于全心脏结构的主要特征信息,并消除其他干扰全心脏结构分割的信息。在解码结构中,注意力机制通过与下一个反卷积层级联以达到融合互补特征信息的目的,进而将高低维特征相结合,更加有利于恢复和提取全心脏结构尤其是肺动脉小血管的细节特征和左心室心肌的边缘信息,以提高分割精度。因此,将注意力机制添加到U-Net中可以接收更多的低维和高维特征,从而更好地抑制背景信息和噪声的干扰,对于心脏各结构组织边缘的分割有一定的帮助。

3 实验与分析

3.1 数据获取与数据处理

本文所使用的20例CT数据由MM-WHS 2017挑战赛提供,其中14例用作训练,2例用作验证,4例用作测试。MM-WHS 2017挑战赛所提供的数据标签灰度在0~850之间,对标签灰度值重新处理到0~7之间,原始标签灰度值与处理后的标签灰度值如表1所示。

数据归一化:由于MM-WHS 2017挑战赛所提供的原始数据集灰度值在几十到几千的范围,所以为了加快神经网络的训练,本文对原始数据进行了归一化处理。

数据扩充:由于本课题仅有14例样本用于训练,这种数据量级别远远不满足深度学习所需的样本数量。但是由于图像分割实际上是对像素点的分类,所以本课题对全心脏结构的每一个像素点进行分类,这相当于间接扩大了数据量。另外,为了进一步扩大数据集,我们对实验数据进行了随机裁剪、旋转的操作。

3.2 评价方法

为了定量的分析网络性能和分割结果,采用了Dice similarity coefficient(DSC)评价指标,该评价指标的计算公式如式(1)所示:

(1)

其中:X,Y分别表示真实标签和预测结果。

此外,因为交叉熵(Cross entropy)可以避免学习率过低的问题,所以实验中使用交叉熵作为损失函数对模型训练进行误差统计。其定义如式(2)所示:

(2)

其中:n为类别数量,p(xi)为真实标签概率分布,q(xi)为网络预测概率分布。网络预测概率分布越接近于真实标签概率分布,交叉熵越小,分割结果越好。

3.3 实验结果与分析

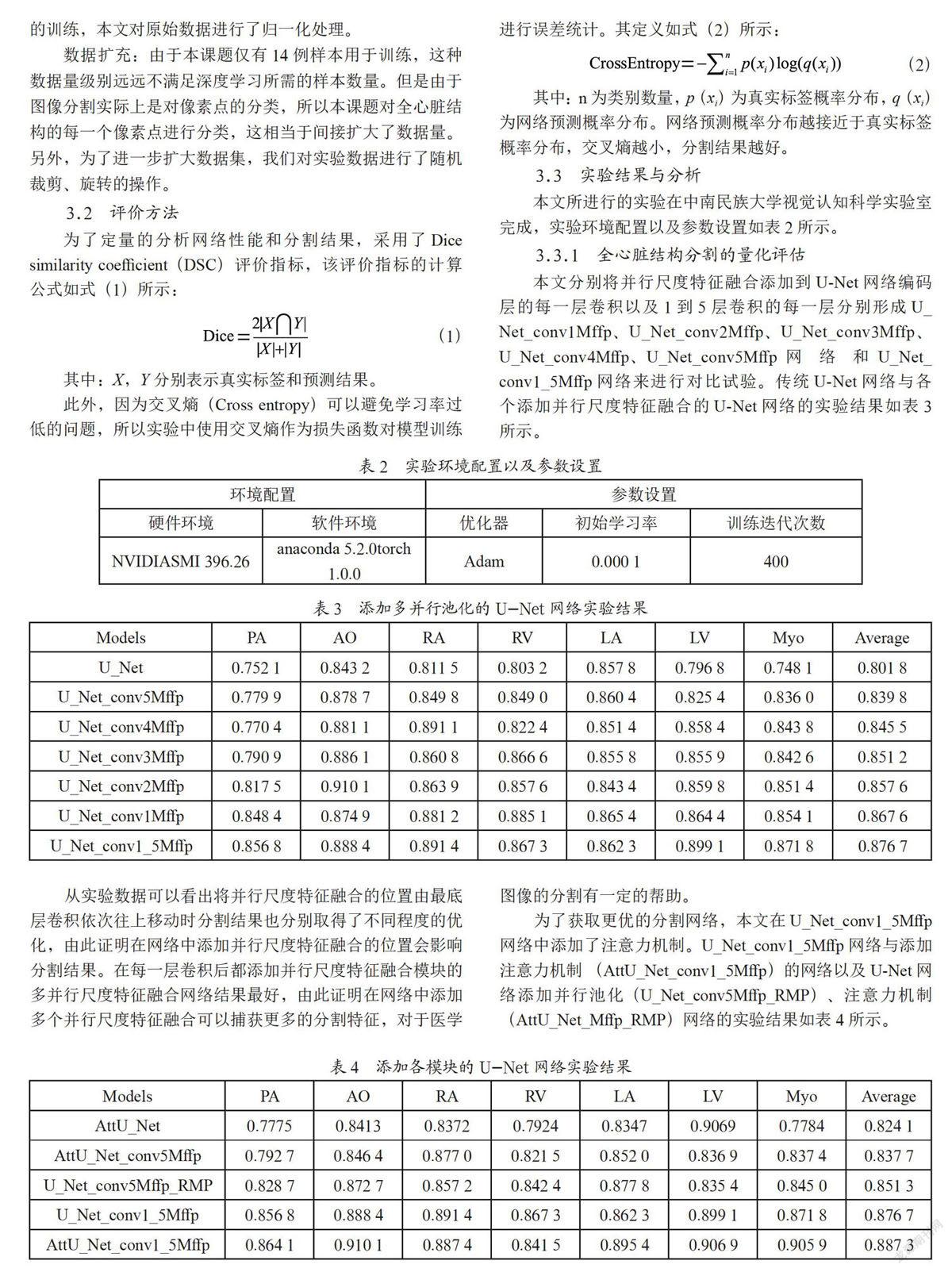

本文所进行的实验在中南民族大学视觉认知科学实验室完成,实验环境配置以及参数设置如表2所示。

3.3.1 全心脏结构分割的量化评估

本文分别将并行尺度特征融合添加到U-Net网络编码层的每一层卷积以及1到5层卷积的每一层分别形成U_Net_conv1Mffp、U_Net_conv2Mffp、U_Net_conv3Mffp、U_Net_conv4Mffp、U_Net_conv5Mffp网络和U_Net_conv1_5Mffp网络来进行对比试验。传统U-Net网络与各个添加并行尺度特征融合的U-Net网络的实验结果如表3所示。

从实验数据可以看出将并行尺度特征融合的位置由最底层卷积依次往上移动时分割结果也分别取得了不同程度的优化,由此证明在网络中添加并行尺度特征融合的位置会影响分割结果。在每一层卷积后都添加并行尺度特征融合模块的多并行尺度特征融合网络结果最好,由此证明在网络中添加多个并行尺度特征融合可以捕获更多的分割特征,对于医学图像的分割有一定的帮助。

为了获取更优的分割网络,本文在U_Net_conv1_5Mffp网络中添加了注意力机制。U_Net_conv1_5Mffp网络与添加注意力机制 (AttU_Net_conv1_5Mffp)的网络以及U-Net网络添加并行池化(U_Net_conv5Mffp_RMP)、注意力机制(AttU_Net_Mffp_RMP)网络的实验结果如表4所示。

从实验数据可以看出在U_Net_conv1_5Mffp网络中添加注意力机制对于除去背景信息的抑制和噪声的干扰有一定的作用,添加注意力机制有助于医学图像的分割。

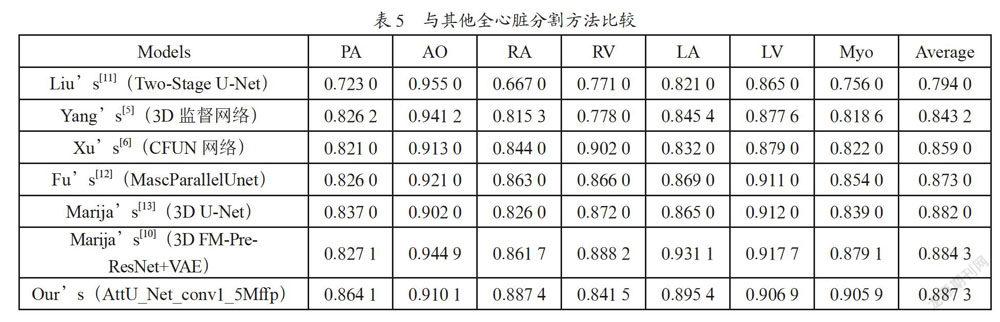

将本文提出的全心脏分割方法与Marija等[10]提出的全心脏分割方法进行比较,对比结果如表5所示。

结果显示本文提出的网络结构与对比网络相比在Dice值方面较为突出,进而证明了该方法在全心脏分割方面的有效性及分割优势。尤其在肺动脉分割方面,由于本文提出的网络添加了多个空洞卷积模块,使得网络可以学习到影像的更多全局信息,很好地解决了肺动脉小血管分割不完整的问题。因为左心室心肌周围的心脏子结构较多导致心肌边缘模糊,而注意力机制的添加对组织边缘的分割有一定的帮助,所以左心室心肌的分割与对比网络相比也表现出了突出的优势。同时,相比于3D网络分割和两个阶段的网络分割,本文提出的2D网络结构仅通过一步就完成了全心脏结构的分割,耗时、计算量更少,避免了大量时间资源和内存资源的浪费。综合分析来看,本文提出的网络结构在进行CT图像全心脏分割时,不仅可以得到较为突出的分割结果,尤其是肺动脉和心肌的分割,同时还具有耗时更短,计算量更少的优势。

3.3.2 全心脏结构分割的视觉效果

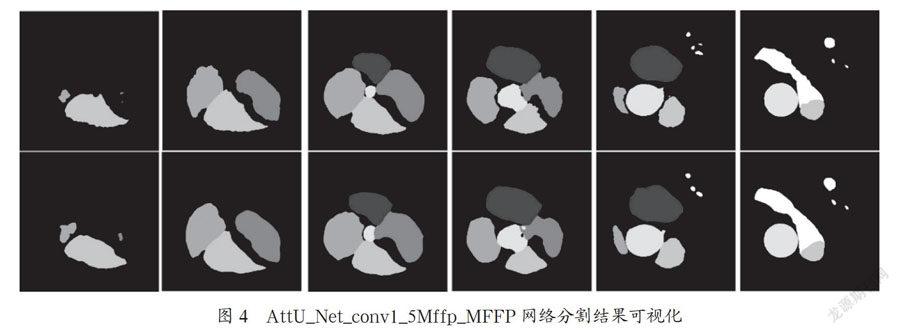

本文通过将多并行尺度特征融合和注意力机制应用到传统U-Net网络[14]中,有效的分割出了全心脏结构。图4显示了一例测试数据通过AttU_Net_conv1_5Mffp网络的部分切片的预测结果。

其中第一行是真实标签图片、第二行是相应切片通过网络的分割结果。从分割结果可以看出,网络分割结果和真实标签相比有很高的相似度,一些细小的动脉血管及心肌边缘该网络都可以准确预测出来,由此证明该网络可以很好地分割出全心脏结构。

4 结 论

本文基于介入手术导航和心血管疾病诊断与治疗的基本需求,针对全心脏结构中各部位边界模糊、尺寸大小差别较大等问题,结合胸部增强CT图像的影像特征,提出了一种融合多并行尺度特征融合和注意力机制的改进U-Net网络的全心脏CT图像分割方法。在特征提取部分加入多并行尺度特征融合扩大了感受野且保留了细小特征;在U-Net网络解码阶段加入注意力机制更有效的恢复了图像的边界信息。通过使用MM-WHS数据集在传统的U-Net网络以及添加各模块的验证网络显示:本文提出的分割网络整体性能较优,有着比较高的准确度,分割结果比较可观。

虽然该方法利用深度学习解决了传统方法耗时耗力的问题,对全心脏结构的分割有很大的帮助,但是分割性能仍有待提升,原因可能是数据的预处理不够突出以及数据量不够导致学习不充分。后续我们也会针对目前存在的问题做进一步的优化,并对整个胸腔器官的分割进行研究以对介入手术进行导航。

参考文献:

[1] 胡盛寿,高润霖,刘力生,等.《中国心血管病报告2018》概要 [J].中国循环杂志,2019,34(3):209-220.

[2] ZHUANG X. Challenges and methodologies of fully automatic whole heart segmentation:a review [J].Journal of Healthcare Engineering,2013,4(3):371-408.

[3] ZHUANG X,SONG J,ZHAN S,et al. A registration and atlas propagation based framework for automatic whole heart segmentation of CT volumes [C]//SPIE Medical Imaging. Orlando:SPIE,2013.

[4] PAYER C,ŠTERN D,BISCHOF H,et al. Multi-label whole heart segmentation using CNNs and anatomical label configurations [C]//STACOM 2017:Statistical Atlases and Computational Models of the Heart. ACDC and MMWHS Challenges. Quebec:Springer,Cham,2018:190-198.

[5] YANG X,BIAN C,YU L,et al. Hybrid loss guided convolutional networks for whole heartparsing [C]//STACOM 2017:Statistical Atlases and Computational Models of the Heart. ACDC and MMWHS Challenges. Quebec:Springer,Cham,2017:215-223.

[6] XU Z,WU Z,FENG J. CFUN:Combining Faster R-CNN and U-net Network for Efficient Whole Heart Segmentation [J/OL].arXiv.org,2018,1(2018-12-12).https://arxiv.org/abs/1812.04914v1.

[7] YU F,KOLTUN V. Multi-Scale Context Aggregation by Dilated Convolutions [J/OL].arXiv.org,2016,3[2021-06-01].https://arxiv.org/abs/1511.07122.

[8] 叶承钦.基于编解码结构的全心脏CT图像分割 [D].哈尔滨:哈尔滨工业大学,2019.

[9] ZHANG S,FU H,YAN Y,et al. Attention Guided Network for Retinal Image Segmentation [C]//MICCAI 2019:Medical Image Computing and Computer Assisted Intervention – MICCAI 2019.Shenzhen:Springer,Cham,2019:797-805.

[10] HABIJAN M,GALIĆ I,LEVENTIĆ H,et al. Whole heart segmentation using 3D FM-Pre-ResNet encoder–decoder based architecture with variational autoencoder regularization [J].Applied Sciences,2021,11(9):3912.

[11] LIU T,TIAN Y,ZHAO S,et al. Automatic Whole Heart Segmentation Using a Two-Stage U-Net Framework and an Adaptive Threshold Window [J].IEEE Access,2019,7:83628-83636.

[12] 付殿臣.跨模态心脏医学图像域自适应分割算法研究 [D].长春:长春工业大学,2021.

[13] HABIJAN M,LEVENTIĆ H,GALIĆ I,et al. Neural network based whole heart segmentation from 3D CT images [J].International journal of electrical and computer engineering systems,2020,11(1):[2021-05-31].http://www.etfos.unios.hr/ijeces/papers/neural-network-based-whole-heart-segmentation-from-3d-ct-images/.

[14] RONNEBERGER O,FISCHER P,BROX T. U-Net:Convolutional Networks for Biomedical Image Segmentation [C]//MICCAI 2015:Medical Image Computing and Computer-Assisted Intervention – MICCAI 2015.Munich:Springer,Cham,2015:234-241.

作者简介:陈秋叶(1995—),女,汉族,河南开封人,硕士研究生在读,研究方向:视觉认知与医学图像处理;通讯作者:刘海华(1966—),男,汉族,湖北孝感人,教授,博士,研究方向:视觉认知计算与医学图像处理。